PLUS

生成AIコラム

ChatGPTの危険性とは?情報漏洩・悪用リスクの原因と対策を解説

目次:

はじめに

「ChatGPTを業務で使いたいけど、情報が漏れないか心配」「間違った情報を出力されたらどうしよう」「悪用されるリスクについて知っておきたい」といった不安を抱えるビジネスパーソンは多いでしょう。

その不安を解消するには、ChatGPTの危険性とその原因を正しく理解することが重要です。入力データの漏洩リスクや誤情報の出力、詐欺への悪用など、様々なリスクが存在しますが、それぞれに適切な対策を講じることで、安全に活用できます。また、危険性が生じる仕組みを知ることで、より効果的にリスクを回避できるようになります。

本記事では、ChatGPTの主な危険性とその原因、具体的な対策方法を詳しく解説します。情報漏洩を防ぐ設定方法や、誤情報への対処法、悪用事例まで網羅的に紹介しているので、ChatGPTを安全に使いたい方は、ぜひ参考にしてください。

生成AIの社内利用をお考えの企業様へ

ナレフルチャットは業界最安級のコストパフォーマンスで、社内の生成AI活用を支援するツールです。情報漏洩のリスクを抑えながら、誰でも簡単にAIを業務で活用できます。

企業のAI導入を検討している方は、こちらをご覧ください。ChatGPTの危険性とは

ChatGPTには大きく分けて3つの危険性があります。これらはChatGPTの仕組みや利用環境によって引き起こされるリスクです。

- 入力データの漏洩

- 誤情報や問題のある情報の出力

- 詐欺等への悪用

また、次章以降では、それぞれの危険性がなぜ起こるのか、ChatGPTの仕組みを交えながら詳しく解説し、各リスクに対する具体的な対策も紹介していきます。

入力データの漏洩

ユーザーが入力した情報が第三者に知られるリスクです。ChatGPTは入力されたプロンプトを学習に使用するため、機密情報が他のユーザーへの回答に含まれてしまう可能性があります。

- プロンプトが学習データとして使用され、他のユーザーへの回答に反映される

- チャット履歴のリンク共有機能を使用した際に、誤送信で情報が漏れる

- 共有したリンクが第三者に転送され、意図しない相手に閲覧される

また、ChatGPTのリンク共有機能は便利な一方で、送信先を誤ると全てのチャット履歴が閲覧されてしまうため、慎重な取り扱いが必要です。

誤情報や問題のある情報の出力

事実と異なる内容や、倫理的・法的に問題のある情報が生成されるリスクです。ChatGPTは文脈として自然な回答を優先するため、事実関係の正確性が犠牲になる場合があります。

- 存在しない論文や統計データを創作してしまう

- 実際とは異なる事実や数値を自然な文章で出力する

- 著作権に触れる内容や倫理的に問題のある情報を生成する

特に最新情報や専門的な知識については、学習データに含まれていない可能性が高く、もっともらしい内容を推測で生成してしまうことがあります。業務で使用する情報や公開予定のコンテンツについては、必ず信頼できる情報源での事実確認が必要です。

詐欺等への悪用

ChatGPTを使った詐欺やサイバー攻撃に利用されるリスクです。高度な文章生成能力により、従来は専門知識が必要だった攻撃手法が、誰でも簡単に実行できてしまう可能性があります。

- 自然な文章で精巧なフィッシングメールを大量作成する

- Webサイトの脆弱性を突くプログラムやマルウェアを生成する

- 事実に基づかないフェイクニュースを大量生成し、SNSで拡散させる

技術的なハードルが下がることで、サイバー攻撃や詐欺の件数が増加するリスクが懸念されています。フィッシングメールは従来、不自然な日本語で見分けやすいものでしたが、ChatGPTを使えば違和感のない文章で説得力のある詐欺メールを作成できてしまうのです。

入力データが漏洩する原因と対策例

入力データの漏洩リスクは、ChatGPTの学習の仕組みや共有機能の特性から生じます。ここでは主な原因と、それぞれの対策方法を解説します。

- プロンプトが学習に使用される

- 誤った相手にリンク共有してしまう

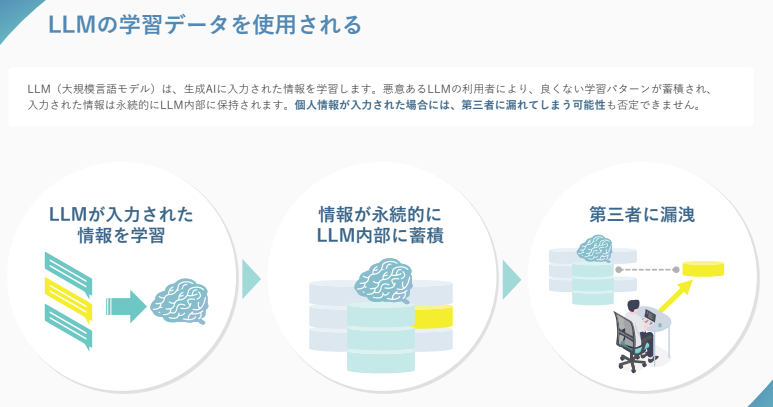

プロンプトが学習に使用される

ChatGPTは、ユーザーが入力したプロンプト(質問文や指示文)をAIモデルの学習に使用します。この学習データは、将来的にChatGPTの回答に反映される可能性があるため、機密情報を入力すると、他のユーザーへの回答に含まれてしまうリスクがあります。

ChatGPTでは、チャット履歴全体が学習対象となり、プロンプトだけでなく、AIの回答に対するフィードバックやチャット内の全てのやり取りが含まれます。

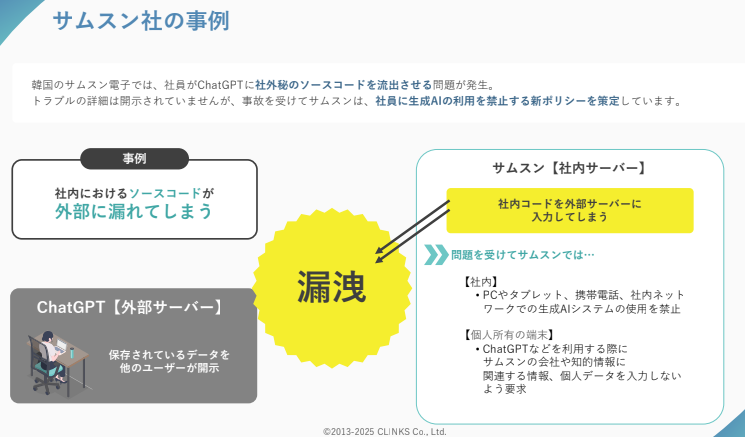

実際に、2023年にサムスン電子の社員が、社外秘のソースコードをChatGPTに入力したことで、情報漏洩の懸念が生じた事例が報告されました。

このように、業務上の重要情報を安易に入力すると、企業の競争力を損なう可能性があります。学習されたデータは不特定多数のユーザーの回答生成に使われるため、一度入力した情報を完全に削除することは困難です。

このリスクへの対策は、大きく分けて2つあります。

1つ目は、ChatGPTの設定画面から学習をオプトアウトすることです。設定画面の「データコントロール」から「すべての人のためにモデルを改善する」をオフにすれば、入力データが学習に使用されなくなります。

詳しくは、以下の記事で詳しく解説しておりますので、ご参照ください。

参考記事:ChatGPTに学習させないオプトアウトとは?設定方法からリスク対策例まで解説

2つ目は、そもそも機密情報を入力しないという運用ルールを徹底することです。顧客情報、財務データ、未公開の商品情報など、社外秘の情報は入力を避けるべきでしょう。

特に企業で利用する場合は、どのような情報を入力してはいけないのか、具体例を示したガイドラインを策定し、従業員への教育を実施することが効果的です。

情報漏洩の事例や対策については以下の記事で詳しく解説しておりますので、ご参照ください。

参考記事:ChatGPTの情報漏洩リスクとは?3つの事例と11の対策方法を紹介

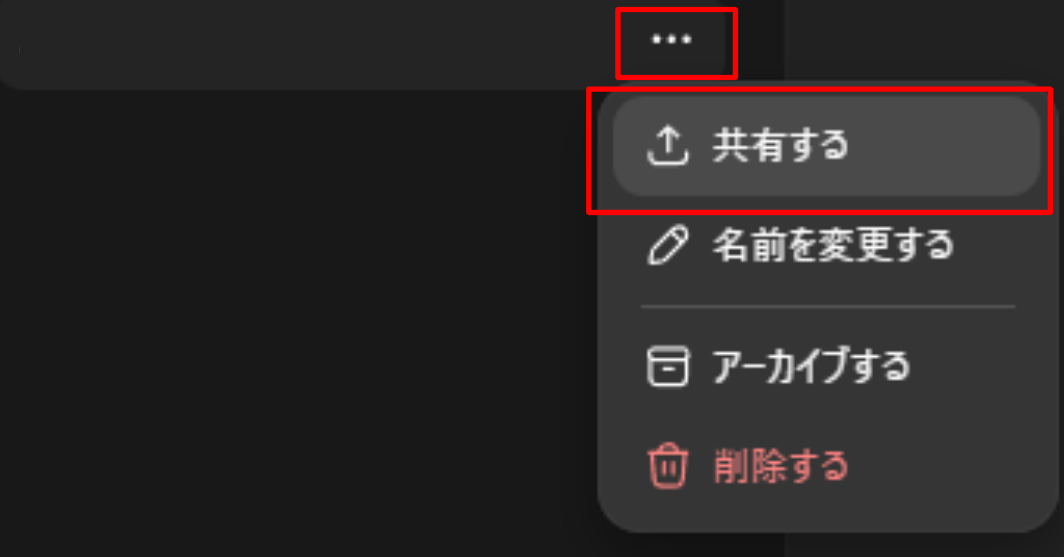

誤った相手にリンク共有してしまう

ChatGPTには「リンクを共有」機能があり、チャット履歴をURLで他者と共有できます。この機能は便利な一方で、誤って社外の人にリンクを送ってしまうと、そのチャット内の全てのやり取りが閲覧されてしまいます。リンクを受け取った相手は、ChatGPTのアカウントを持っていなくても、そのURLにアクセスするだけでチャット内容を見られます。

メールやチャットツールでの誤送信は珍しくないため、意図せず機密情報が流出するリスクは決して低くありません。また、そのリンクがさらに第三者に転送される可能性もあるため、共有範囲のコントロールが難しいという問題もあるでしょう。

対策としては、リンク共有機能を使う際には、送信先を慎重に確認することが重要です。機密度の高い内容を含む場合は、リンク共有ではなく、必要な部分だけをコピー&ペーストする方が安全でしょう。

また、企業向けの生成AIチャットサービスを利用するのも有効な選択肢です。

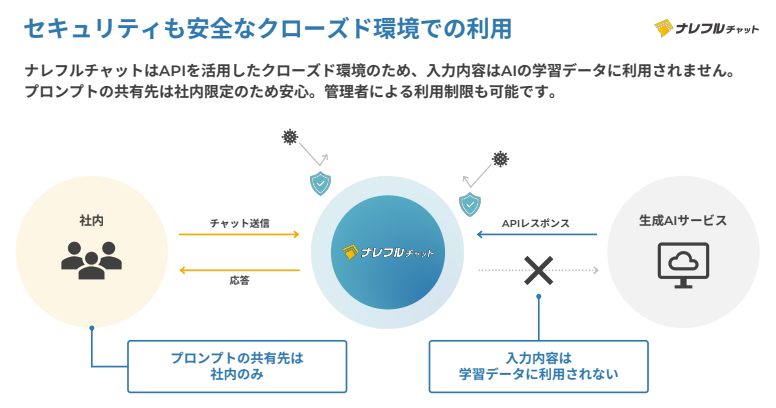

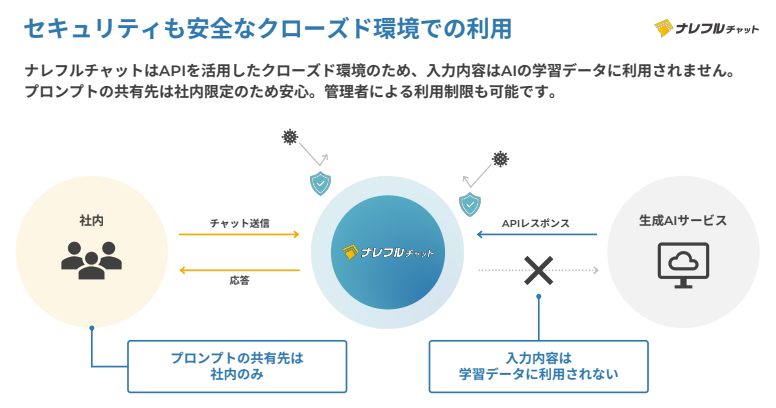

法人向けChatGPT・クローズド生成AIチャットサービス「ナレフルチャット」では、クローズド環境で入力データが学習に使用されない設計になっており、情報漏洩のリスクを最小限に抑えられます。

管理者が利用ユーザーを制限でき、プロンプトの共有先も社内に限定されているため、誤って社外に情報が流出する心配がありません。さらに、ISMS認証(ISO27001)とプライバシーマークを取得した企業が開発・運営しているため、セキュリティ面でも安心して利用できます。

誤情報や問題のある情報が出力される原因と対策例

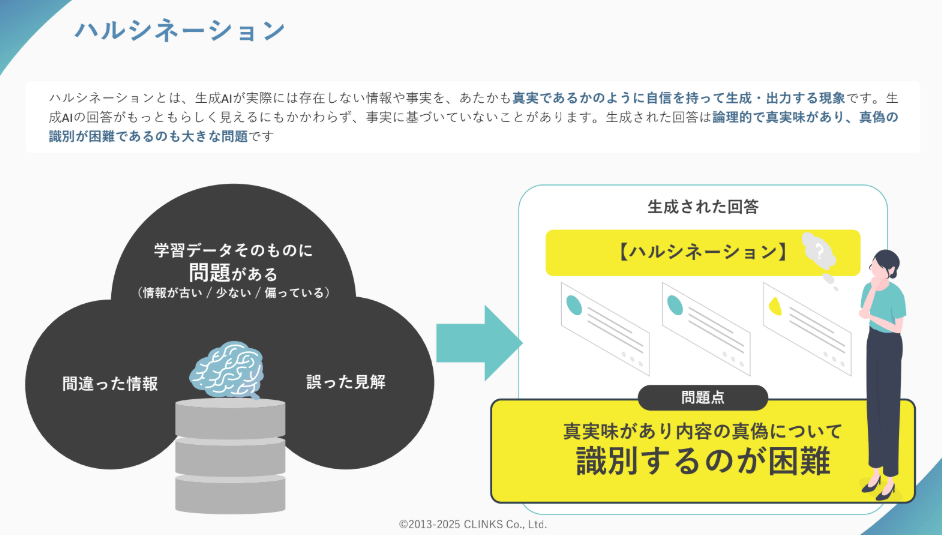

ChatGPTは高精度な回答を生成しますが、時として事実と異なる情報や、倫理的・法的に問題のある内容を出力することがあります。この現象の原因は主に「ハルシネーション」「回答の不安定さ」「最新情報へのアクセス制限」の3つです。

ChatGPTが誤情報を出力する主な原因は「ハルシネーション」と呼ばれる現象です。ハルシネーションとは、AIが実在しない情報をもっともらしく生成してしまうことを指します。

ChatGPTは「次に来る単語として確率の高いものを選ぶ」という仕組みで文章を生成するため、事実関係の正確性よりも、文脈として自然な回答を優先してしまう場合があります。この仕組みによって、存在しない論文の引用や、実際とは異なる統計データ、架空の事例などが生成されることがあるのです。

また、ChatGPTは同じ質問を繰り返すと、毎回微妙に異なる回答が返ってくる仕組みになっています。例えば、人間に対して「今日は何を食べようかな?」と聞いた時、毎回「ご飯」と答えられても困るように、ちょっとしたランダム性があることで人間らしい多様性のある対話を実現しているのです。

ただし、業務で一貫した回答が必要な場面では、複数回質問して回答の一貫性を確認することが重要です。

ChatGPTの仕組みについては、以下の記事で詳しく解説していますので、ご参照ください。

参考記事:うさぎでもわかる ChatGPTの仕組み AIの中身をやさしく解説!

さらに、ChatGPTの学習データには「カットオフ」と呼ばれる期限があり、それ以降の最新情報については回答できません。これは、AIモデルの学習が特定の時点までのデータに基づいて行われるためです。

各モデルのカットオフ日については、OpenAI公式サイトのプラットフォームのページで確認できます。これにより、例えば今年の制度改正の内容や特定の会社の最新動向などについては、正確な情報を得られない可能性があるでしょう。

ChatGPTの学習期間については、こちらの記事で詳しく解説しておりますので、ご参照ください。

参考記事:ChatGPTの学習データはいつまで?最新データを取得する3つの方法も解説

これらの問題への対策としては、ChatGPTの出力内容を必ずチェックすることが重要です。また、回答精度を上げるには、具体的で明確なプロンプトを入力することが大切です。

| 対策の種類 | 具体的な方法 |

|---|---|

| 出力内容の事実確認 | 信頼できる一次情報源(公式サイト、学術データベース、ニュースメディア)で裏付けを取る |

| プロンプトの改善 | 「〇〇について、△△の観点から説明してください」のように条件を明確にする |

| 最新情報へのアクセス | ChatGPTのWeb検索機能や、Perplexity AIなどの検索系AIツールを併用する 自身でGoogleなどで検索する |

| 回答の一貫性確認 | 業務で使用する場合は、複数回質問して回答の一貫性を確認する |

業務で使用する情報や公開予定のコンテンツについては、信頼できる情報源での事実確認を徹底し、リアルタイムの情報が必要な場合は、公式サイトやニュースサイトなど、最新情報を扱う情報源も確認することが重要です。

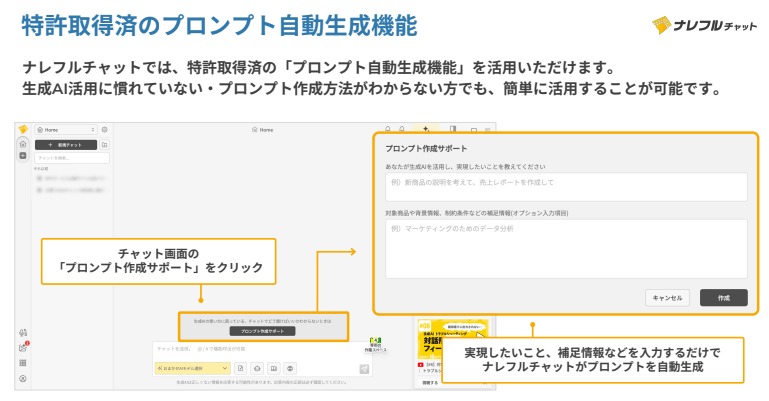

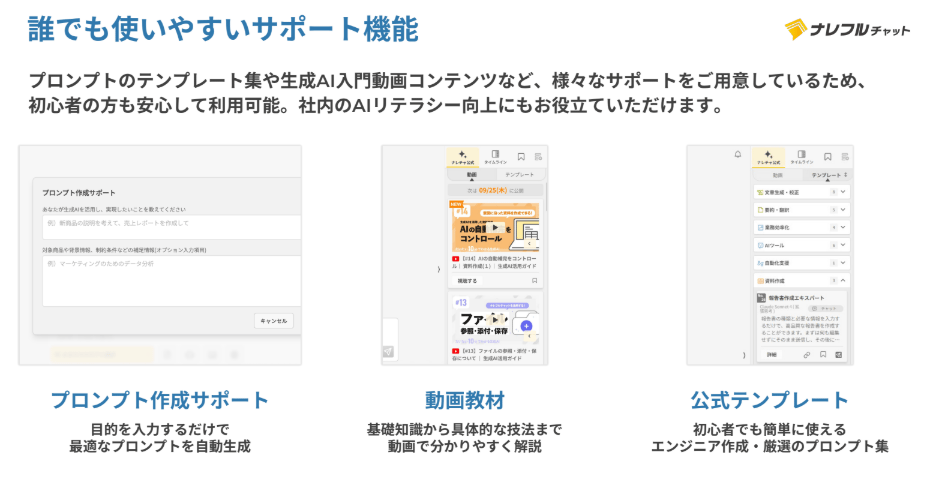

ナレフルチャットでは、特許取得済みのプロンプト自動生成機能を搭載しており、AIが利用者の意図を理解して最適なプロンプトを自動で作成します。

この機能を活用すれば、プロンプトの書き方に不慣れなユーザーでも、高精度な回答を引き出しやすくなります。さらに、思った通りの応答が得られない場合は、AIで自動改善することも可能です。

ChatGPTが悪用される例

ChatGPTの高度な文章生成能力やプログラミング能力は、残念ながら悪意のある目的にも利用できてしまいます。被害を受けないようにするためには、どのような悪用がされうるのか知っておくことが必要です。ここでは、実際に懸念されている悪用事例を紹介します。

- フィッシング詐欺への悪用

- 詐欺サイトやマルウェア等の作成

- フェイクニュースの拡散

フィッシング詐欺への悪用

ChatGPTの文章生成能力は、フィッシング詐欺メールの作成に悪用される可能性があります。従来のフィッシングメールは、不自然な日本語や文法ミスが多く、比較的見分けやすいものでした。特に、海外の攻撃者が作成したメールは、日本語として違和感のある表現が含まれることが多く、それが見破る手がかりになっていました。

しかし、ChatGPTを使えば、日本語が母国語でない攻撃者でも、違和感のない自然な日本語のメールを大量に作成できてしまいます。金融機関や大手企業を装ったメールで、個人情報や認証情報を盗み取る手口が、より巧妙化する恐れがあります。

また、複数回のやり取りが必要なビジネスメール詐欺(BEC)やロマンス詐欺においても、ChatGPTを使えば自然な返信メールを生成できるため、被害者が詐欺だと気づきにくくなる可能性があるでしょう。

詐欺サイトやマルウェア等の作成

ChatGPTは、プログラミングコードの生成も得意としています。この能力を悪用すれば、詐欺サイトの構築や、マルウェア(悪意のあるソフトウェア)の作成に利用される可能性があります。

専門的なプログラミング知識がなくても、ChatGPTに指示を出すだけで、Webサイトの脆弱性を突くスクリプトや、ユーザーのデータを盗み取るコードを生成できてしまう恐れがあります。

また、本物そっくりの詐欺サイトを短時間で構築することも可能です。企業のロゴやデザインを模倣したサイトを作成し、クレジットカード情報や個人情報を入力させる手口が増加する可能性もあるでしょう。

フェイクニュースの拡散

ChatGPTは、事実に基づかない情報でも、もっともらしい記事や報道風の文章を生成できます。この能力が、フェイクニュースの大量生成と拡散に悪用される懸念があります。

例えば、政治的な主張や商業的な目的で、事実と異なる情報を含む記事を大量に生成し、SNSやWebサイトで拡散させることが技術的に可能です。ChatGPTが生成する文章は自然で説得力があるため、読者が真偽を判断しにくい状況が生まれます。これにより、社会的な混乱や企業の風評被害につながる可能性があるのです。

また、虚偽の統計データや存在しない専門家の意見を含む記事を作成し、それをあたかも信頼できる情報源からの引用であるかのように装うことも可能です。情報を受け取る側としては、複数の信頼できる情報源で事実確認を行うことが重要です。

ChatGPTを安全に利用する方法まとめ

ここでは、ここまで紹介してきた危険性と対策を踏まえて、ChatGPTを安全に利用するためのポイントをまとめていきます。これらの対策を組み合わせることで、リスクを大きく軽減できます。

入力データの漏洩、誤情報の出力、悪用事例への対策として、以下のポイントを押さえておきましょう。

対策ポイント

- ChatGPTの設定画面からオプトアウト設定をする

- 顧客情報、財務データ、未公開の商品情報など、社外秘の情報は入力しない

- ChatGPTの出力内容を必ず確認し、信頼できる情報源で事実確認を行う

- 具体的で明確な条件を含むプロンプトを入力し、回答精度を高める

- フィッシングメールや詐欺サイトへの警戒心を持ち、メールやメッセージ内のリンクをクリックする前に送信元を確認する

上記について個人で対策することに加えて、企業全体でガイドラインを策定し、従業員への教育を実施することが効果的です。特に、どのような情報を入力してはいけないのか具体例を示すことで、意図しない情報漏洩を防げます。ChatGPTのリンク共有機能を使う際には、送信先を慎重に確認し、機密度の高い内容は共有を避けることも重要です。

また、企業としてセキュリティ教育を定期的に実施し、最新の脅威情報を従業員と共有することも欠かせません。基本的な対策を徹底することはもちろん、従業員のAIリテラシーを上げることで、ChatGPTの利便性を享受しながらリスクを最小限に抑えられます。

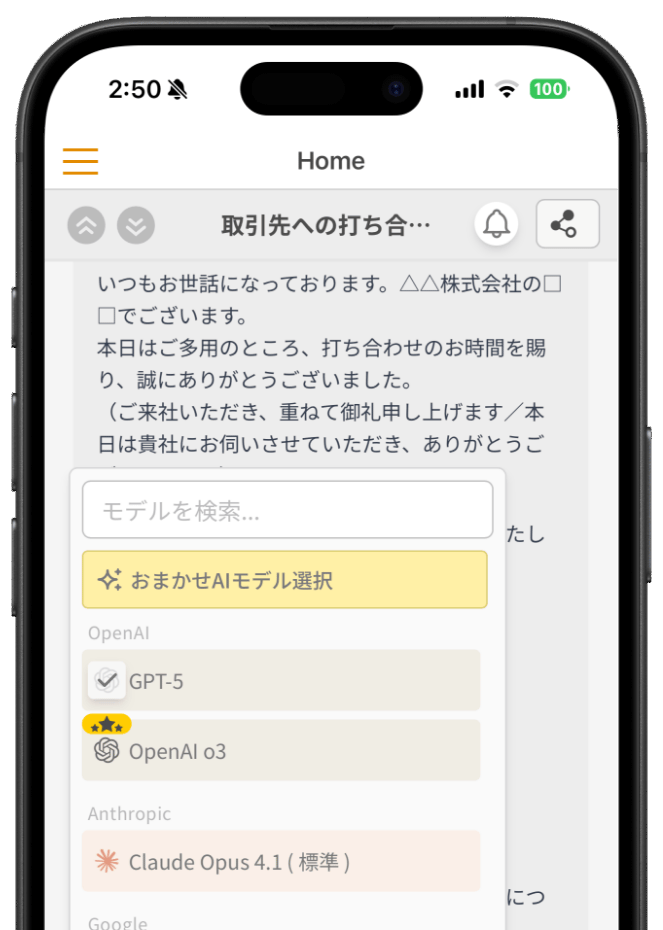

企業で安全にChatGPTを使うならナレフルチャット

企業でChatGPTを安全に活用したい場合、セキュリティ機能が強化された法人向けサービスの利用がおすすめです。ナレフルチャットは、情報漏洩のリスクを抑えながら、生成AIの高い生産性を業務で活用できる法人向けChatGPT・クローズド生成AIチャットサービスです。

ナレフルチャットの最大の特徴は、入力データが学習に使用されず、AIプロバイダー側にも保存されない設計になっている点です。

まず、学習データに利用されないAPI を活用しているため、入力内容は学習データに一切利用されません。

さらに、ChatGPT・ClaudeにおいてZDR(Zero Data Retention/ゼロデータ保持)に対応しており、ユーザーが入力したデータや生成された応答内容がAIプロバイダー側に保存されることなく処理されます。これにより、顧客データ、製品設計書、社内戦略文書など、高度な機密性を持つ情報も安心して活用できます。

詳しくはこちらをご参照ください。

参考記事:ナレフルチャット、ChatGPT・ClaudeでZDR(ゼロデータ保持)を実現~企業の機密情報を保存しない安心・安全な生成AI活用環境を提供~

また、ナレフルチャットはISMS認証(ISO27001)とプライバシーマークを取得した企業が開発・運営しています。これらの特徴から、企業のセキュリティ要件を満たすことができるサービスと言えます。

加えて、特許取得済みのプロンプト自動作成機能を搭載しており、AIが利用者の意図を理解して最適なプロンプトを自動で作成してくれます。この機能を活用すれば、プロンプトの書き方に不慣れなユーザーでも、高精度な回答を引き出しやすくなり、ハルシネーションのリスクを減らせます。

他にも、プロンプトのテンプレート集や生成AI入門の動画教材も用意されているため、初心者の方も安心して利用を開始できる点も特徴です。

ナレフルチャットは、業界最安級のコストパフォーマンスを実現しており、中小企業でも導入しやすい価格設定になっています。月額40,000円から利用でき、利用人数は無制限の企業単位の定額制。ChatGPT・Gemini・Grok・Claude・Perplexityなど、すべてのAIモデルが利用できます

ChatGPTの利便性を損なうことなく、企業のセキュリティ要件を満たせるため、社内での生成AI活用を検討している企業に最適です。

企業での生成AIの活用をお考えの方は、ぜひご検討ください。

ナレフルチャット運営チーム

法人向けクローズド生成AIチャットサービス「ナレフルチャット」の企画・開発・運用を手がけています。

プロンプト自動生成・改善機能や組織内でのノウハウ共有機能など、独自技術の開発により企業の生成AI活用を支援しています。

「AIって難しそう...」という心の壁を、「AIって面白そう!」という驚きで乗り越えていただけるように

日々刻々と変化する生成AI業界の最新動向を追い続け、魅力的な記事をお届けしていきます。