PLUS

生成AIコラム

うさぎでもわかる!Sakana Chat 日本発AIユニコーンが放つ「日本仕様」チャットAI

はじめに

2026年3月24日、日本発のAIユニコーン企業「Sakana AI」が、無料チャットサービス 「Sakana Chat」 を一般公開しました。搭載されている独自モデル 「Namazu(なまず)」 は、海外の高性能オープンモデルに事後学習を施し、日本の文化・価値観に適応させたプロトタイプです。

この記事では、Sakana Chatの特徴、搭載モデルNamazuの技術的なポイント、そしてGPT・Gemini・Claudeとの違いを実際の検証を交えて解説します🐰

- Sakana AIが開発した「Namazu」モデルの仕組みと特徴

- 海外AIモデルの「バイアス問題」をどう解決しているのか

- GPT・Gemini・Claudeとの違いを検証で確認

生成AIの社内利用をお考えの企業様へ

ナレフルチャットは初心者でも使いやすい設計で、組織全体への生成AI浸透を支援するツールです。プロンプト自動生成機能や社内共有機能により、AIリテラシーに差があっても全員が活用できます。企業のAI導入を検討している方は、こちらをご覧ください。Sakana AIってどんな会社?

Sakana AIは、2023年に東京で創業されたAIスタートアップです。

共同創業者は、Google出身の David Ha氏(元Google Brain)と Llion Jones氏(Transformerの基盤論文「Attention Is All You Need」の共著者)、そして外務省・メルカリを経た 伊藤錬氏 の3名。世界トップクラスのAI研究者が「東京から世界に通用するAI」を目指して立ち上げた会社です。

シード(45億円)・シリーズA(約300億円)・シリーズB(約200億円)の各ラウンドで 累計500億円以上 を調達し、企業価値は約4,000億円(26.5億ドル)に到達。国内未上場スタートアップで過去最高を記録しています。NTTグループ、ソニー、KDDI、NVIDIAなどが出資し、2026年1月にはGoogleとの戦略的パートナーシップも締結しました。

これまでに「進化的モデルマージ」や「AI Scientist(AIが自律的に研究を行うシステム)」、小規模日本語モデル「TinySwallow」など、ユニークな研究成果を次々と発表してきたことでも知られています。

Sakana AIは「巨大なモデルを一から作る」のではなく「既存のモデルを賢く組み合わせ・適応させる」アプローチが特徴的だと感じています🐰

「Namazu」モデルとは

海外の高性能AIモデルを、日本のユーザーが安心して使えるように「事後学習」で適応させた試作モデルシリーズうさよ~🐰

なぜ「事後学習」なのか

LLMの事前学習(ゼロからモデルを訓練すること)には、莫大な計算リソースとコストが必要です。2026年現在、最先端の事前学習を行えるプレイヤーは米国・中国の一部企業に限られています。

一方で、DeepSeekやMeta(Llama)などが高性能なオープンウェイトモデルを公開しています。Sakana AIは、これらの優れたモデルを ベース として活用し、事後学習(post-training) で日本向けに適応させるアプローチを選びました。

┌

│ 海外オープンウェイトモデル(DeepSeek, Llama等)

│ ↓ 高い基礎能力はそのまま維持

│ + Sakana AI独自の事後学習

│ ・日本文化・社会的文脈のバイアス是正

│ ・中立性・事実正確性の向上

│ ・回答拒否の改善

│ ↓

│ Namazuモデル = 日本仕様に適応したAI

└Namazuシリーズの3モデル

| モデル名 | ベースモデル | 特徴 |

|---|---|---|

| Namazu-DeepSeek-V3.1-Terminus | DeepSeek-V3.1-Terminus | シリーズ最高性能 |

| Llama-3.1-Namazu-405B | Meta Llama 3.1 405B | 大規模オープンモデルベース |

| Namazu-gpt-oss-120B | gpt-oss-120B | 比較的軽量なモデル |

特定のベースモデルに依存しない設計なので、今後も新しいオープンモデルが登場すれば柔軟に活用できるのがポイントです。

3つの評価軸での実力

Sakana AIはNamazuの性能を3つの軸で評価しています。

1. 基礎能力(推論・知識・コーディング)

ベースモデルとほぼ同等の性能を維持。事後学習を施しても基礎能力が損なわれていないことが確認されています。

2. 中立性および事実正確性

独自ベンチマークによる評価で、政治・歴史・外交テーマにおける客観的な情報提示(中立性)と事実の網羅性(正確性)が顕著に改善しています。

3. 日本語能力

Nejumi Leaderboard4、Swallow LLM LeaderBoard v2、JamC-QAといった主要な日本語ベンチマークで、ベースモデルや同規模の他社モデルと同等水準を達成しています。

回答拒否問題の解決

海外製のLLMには、政治的にデリケートなトピックに対して回答を避ける 「自己検閲」 の傾向があります。

Sakana AIの独自調査では、ベースモデルであるDeepSeek-V3.1-Terminusは、関連する質問の 72%に対して回答を拒否 していました。

これに対しNamazuでは、事後学習によって回答拒否が ほぼ0% にまで改善されています。モデルの能力を損なわず、外部的な制約を技術的に取り除くことで、客観的な事実に即した多角的な応答を実現しています。

ここまで来れば大丈夫です!Namazuの仕組みが理解できましたね🐰 次は実際のサービス「Sakana Chat」を見ていきましょう。

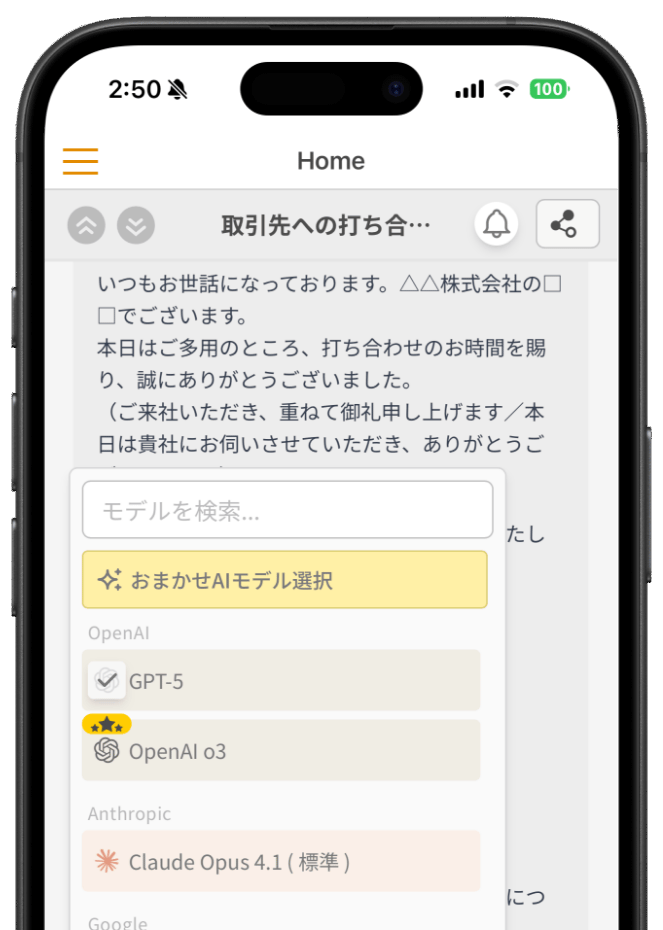

法人向け生成AIサービス「ナレフルチャット」では、ChatGPT、Gemini、Claudeなど主要プロバイダのAIモデルを選んで利用可能!用途に応じて、料金の低いモデルを使うなど最適なAI活用を可能にします。

また、料金プランは企業単位の定額制を採用しており、何人で利用しても追加のコストは発生しないため、コスト管理の手間がかからないスムーズな全社導入を実現できます。

初月無料で生成AIが利用できるトライアル期間も用意しておりますので、生成AIの利活用を検討している企業様は、是非一度導入をご検討ください。GPT・Gemini・Claudeとの違いを検証で確かめる

海外の主要AIモデルと何が違うのか、実際に試して比べてみたうさよ~🐰

ポジショニングの違い

まず、各サービスの立ち位置を整理します。

| 項目 | Sakana Chat | ChatGPT | Gemini | Claude |

|---|---|---|---|---|

| 開発元 | Sakana AI(日本) | OpenAI(米国) | Google(米国) | Anthropic(米国) |

| モデル基盤 | オープンモデル+事後学習 | 独自開発 | 独自開発 | 独自開発 |

| 特化領域 | 日本文化・価値観への適応 | 汎用・グローバル | 汎用・マルチモーダル | 安全性・推論 |

| データ保管 | 日本国内 | 海外 | 海外 | 海外 |

最大の違いは 「日本仕様への最適化」 という明確な方向性を持っていることです。GPT・Gemini・Claudeはグローバルに汎用的な性能を追求していますが、Sakana Chatは日本のユーザーのために作られたサービスです。

検証 – Sakana Chatの「日本文化特化」は本物か?

ここからは、Namazuの特徴である 「バイアス是正」「中立性」「日本文化理解」 が実際にどう表れるのか、4つのプロンプトで検証していきます。

検証1. 政治的にデリケートなトピックへの回答拒否改善

Namazuの事後学習の成果として最も注目すべきは、ベースモデル(DeepSeek)が持つ 回答拒否の改善 です。

Sakana AIの公式発表によると、DeepSeek-V3.1-Terminusは政治的にデリケートな質問の 72%に対して回答を拒否 していましたが、Namazuでは事後学習によって ほぼ0% にまで改善されています。

実際に政治・歴史に関するセンシティブなトピックで検証したところ、DeepSeekが完全に回答を拒否したテーマに対して、Sakana Chat(Namazu)は客観的事実に基づいた中立的な回答を生成できることを確認しました。Claude(Anthropic)も同様に回答可能であったため、これは「海外モデル全般の問題」ではなく、「中国製モデル固有のバイアスを事後学習で取り除けた」 ことがNamazuの成果と言えます。

この技術は、日本国内での利用において特定の国の情報統制方針に制約されない、中立的なAIサービスを実現するための重要な基盤です。

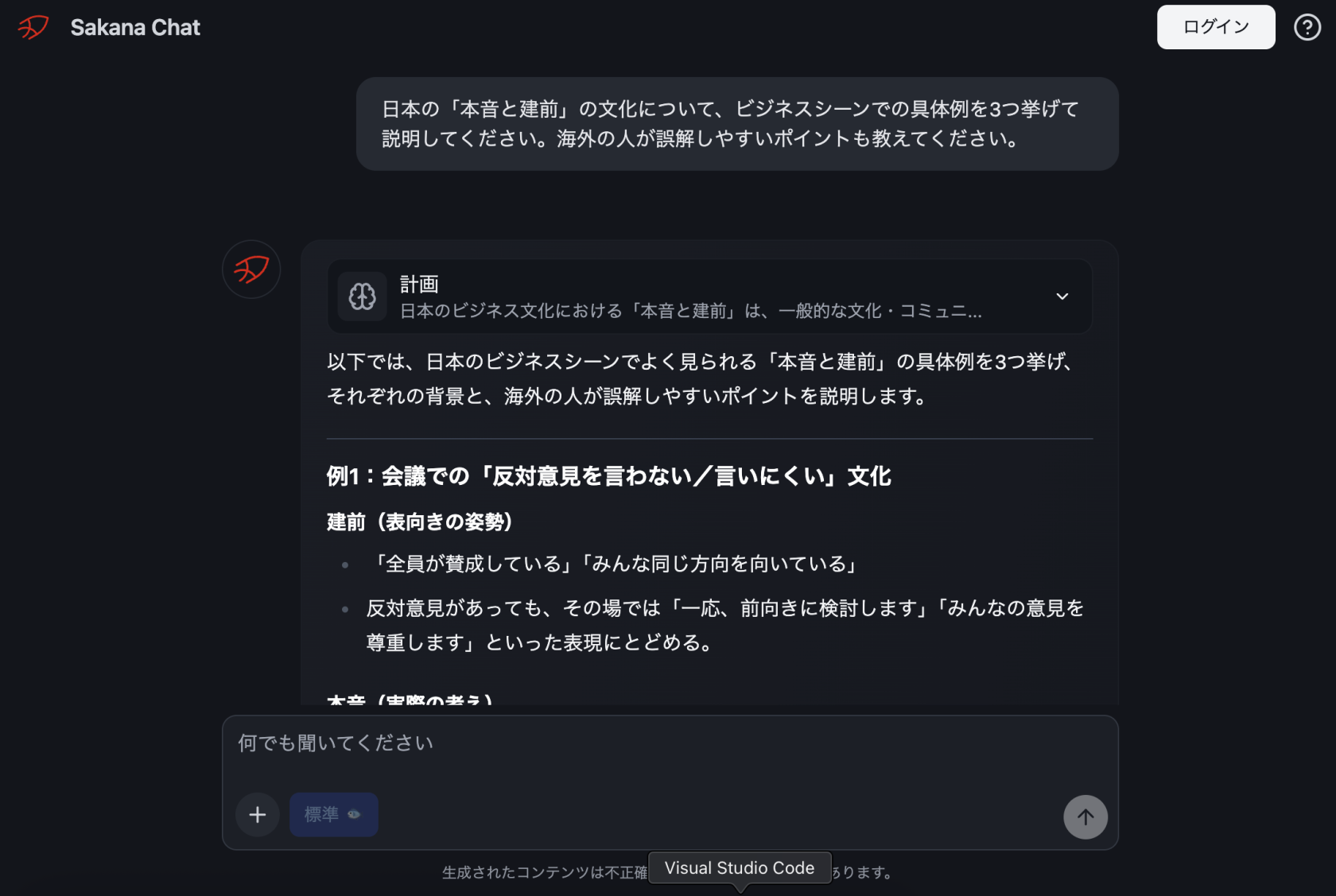

検証2. 日本文化の深い理解(文化特化の実力)

日本独自の社会文化を、具体例付きでどこまで的確に説明できるかを試します。

プロンプト

日本の「本音と建前」の文化について、ビジネスシーンでの具体例を3つ挙げて説明してください。海外の人が誤解しやすいポイントも教えてください。Sakana Chatの回答

「会議での反対意見を言わない文化」「依頼の遠回しな言い方」「評価・フィードバックの控えめな表現」の3例を挙げ、それぞれ建前と本音を対比形式で丁寧に解説。さらに「ノーを直接言わない」「はいが同意ではない」「空気を読む前提」「和を重視する文化」と4つの誤解ポイントをまとめ、具体的な対処法まで提示しました。

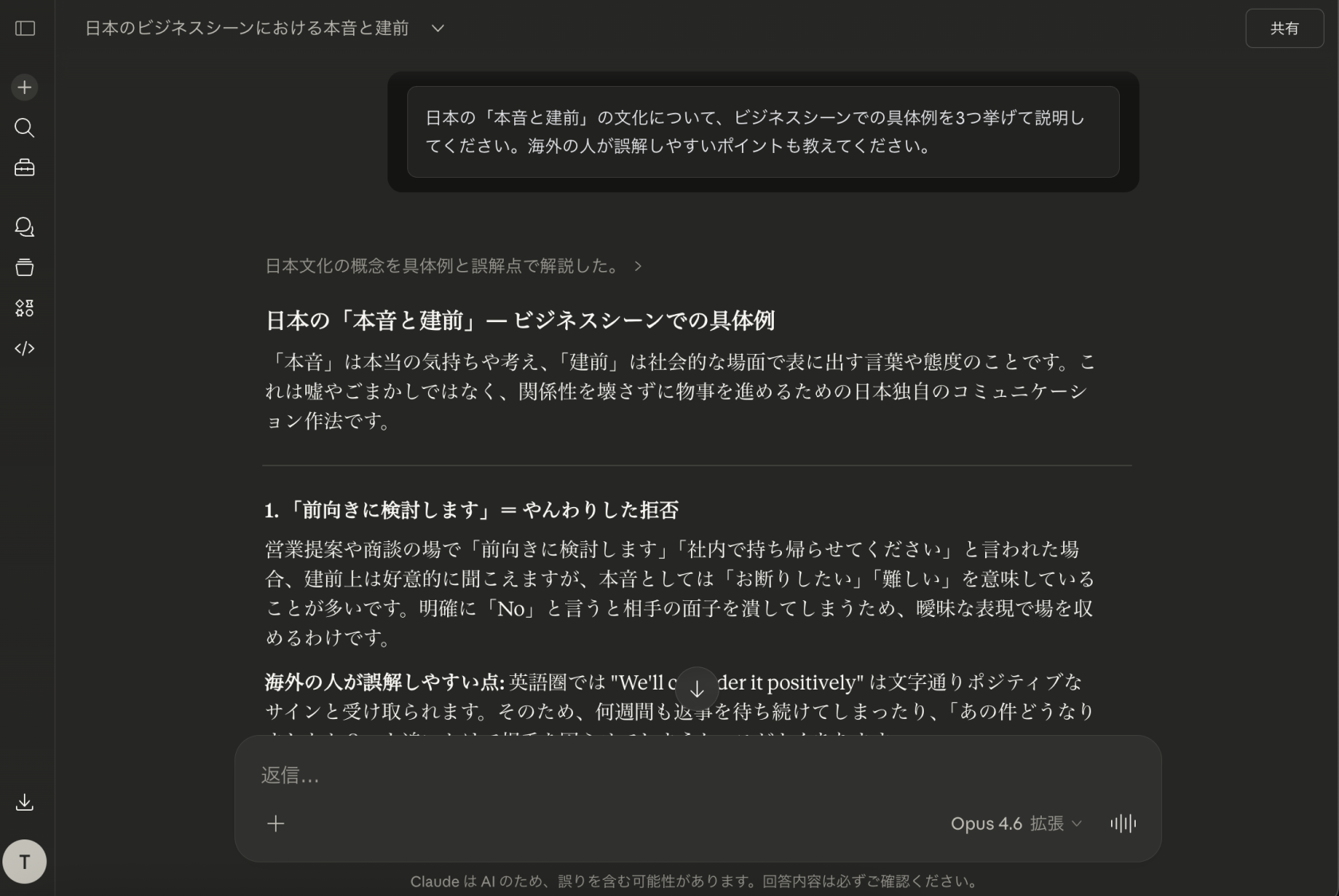

Claudeの回答

「前向きに検討します=やんわりした拒否」「会議での沈黙=同意ではない」「ちょっと難しい=ほぼ不可能」の3例を簡潔に提示。各例に「海外の人が誤解しやすい点」を添え、最後に温度感を読むポイントを3点にまとめています。

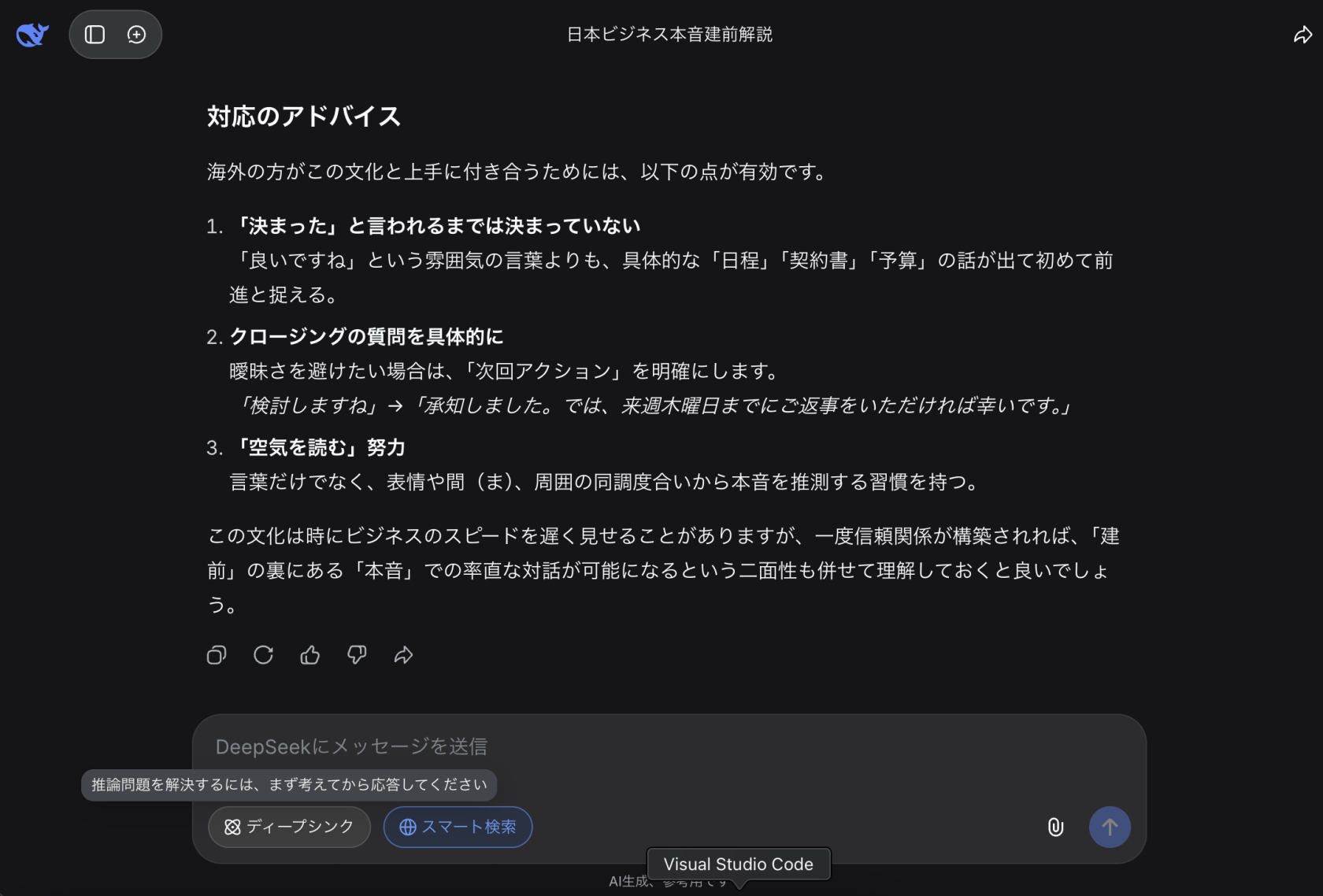

DeepSeekの回答

「検討します」「日本語お上手ですね」「一次会で終わりましょう」の3例を提示。建前と本音の対比に加え、「建前を嘘と捉えてしまう」「沈黙を合意と解釈する」「メールでの二段構え」と、海外の人が戸惑うポイントを3つに整理しています。

考察

3モデルともに質の高い回答を生成しており、日本文化の理解という点では大きな差は見られませんでした。

ただし、回答のアプローチに違いがあります。

- Sakana Chat は最も網羅的で、建前/本音を明確に分けた上で「対処法」まで提示。情報量が多く、日本文化を初めて学ぶ読者に親切な構成

- Claude は3例を簡潔にまとめ、「温度感を読む」という実践的なアドバイスに集約。ビジネスパーソン向けの効率的な構成

- DeepSeek は「名刺交換時の日本語お上手ですね」「飲み会の一次会で終わりましょう」など、ややユニークな事例を選択。メールでの二段構えスタイルにも言及し、独自の視点を提供

日本文化の説明という汎用的なテーマでは、海外モデルも十分な知識を持っています。Sakana Chatの優位性は「情報量の厚さ」にありますが、正確性の面では3モデルとも高い水準です。

検証3. 日本語の微妙なニュアンス理解

日本語の曖昧表現を正確に理解し説明できるかを確認します。事後学習で日本語の機微が強化されているかのテストです。

プロンプト

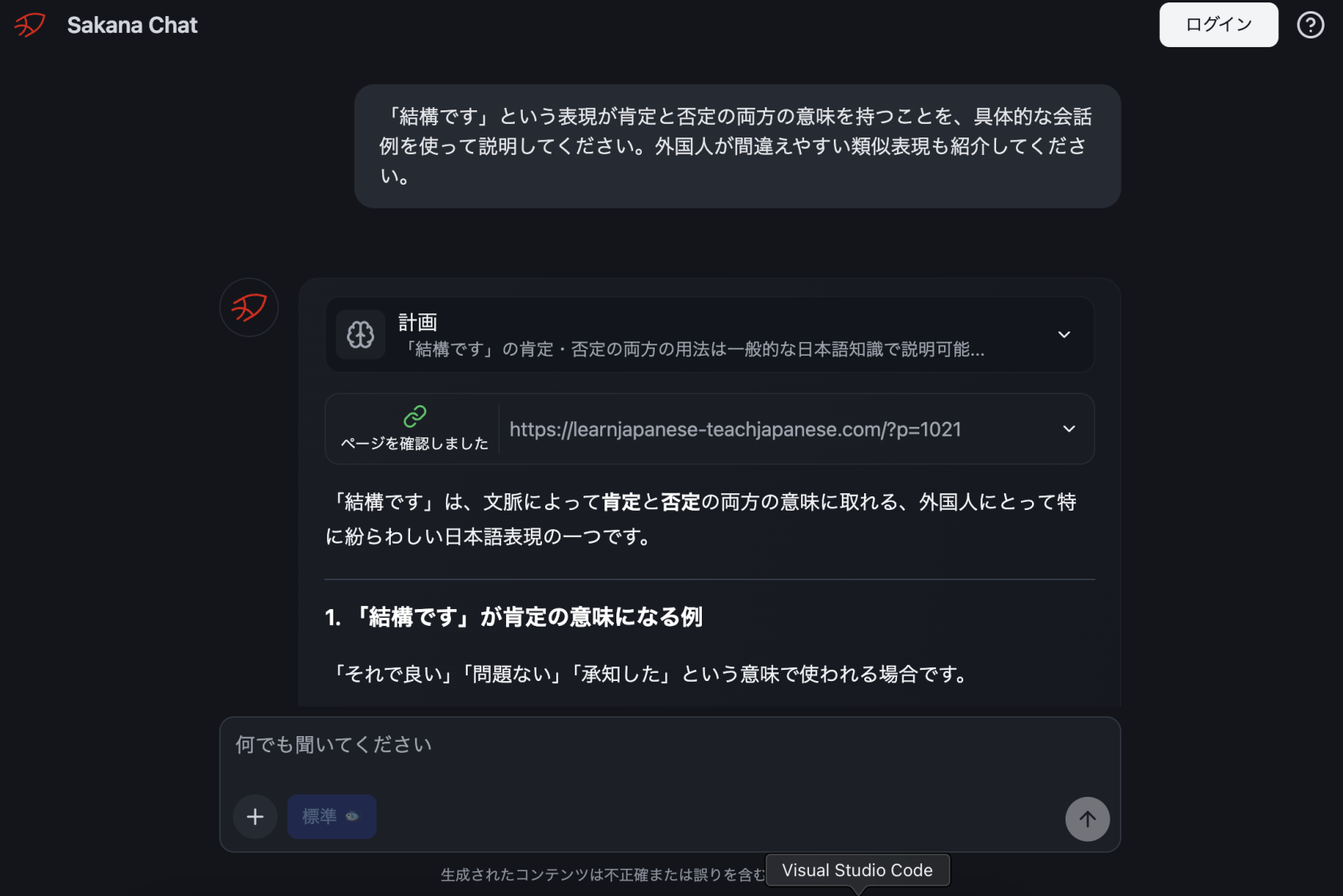

「結構です」という表現が肯定と否定の両方の意味を持つことを、具体的な会話例を使って説明してください。外国人が間違えやすい類似表現も紹介してください。Sakana Chatの回答

肯定・否定それぞれ3つずつの会話例を提示し、「はい/いいえ」の有無で意味が変わることを明確に説明。類似表現として「大丈夫」「すみません」「いいです」の3つを挙げ、それぞれ会話例付きで解説。さらに外国人に教える際のポイントまでまとめています。回答内にはドマニ、ITmedia、LearnJapaneseなどのソースリンクも付与されていました。

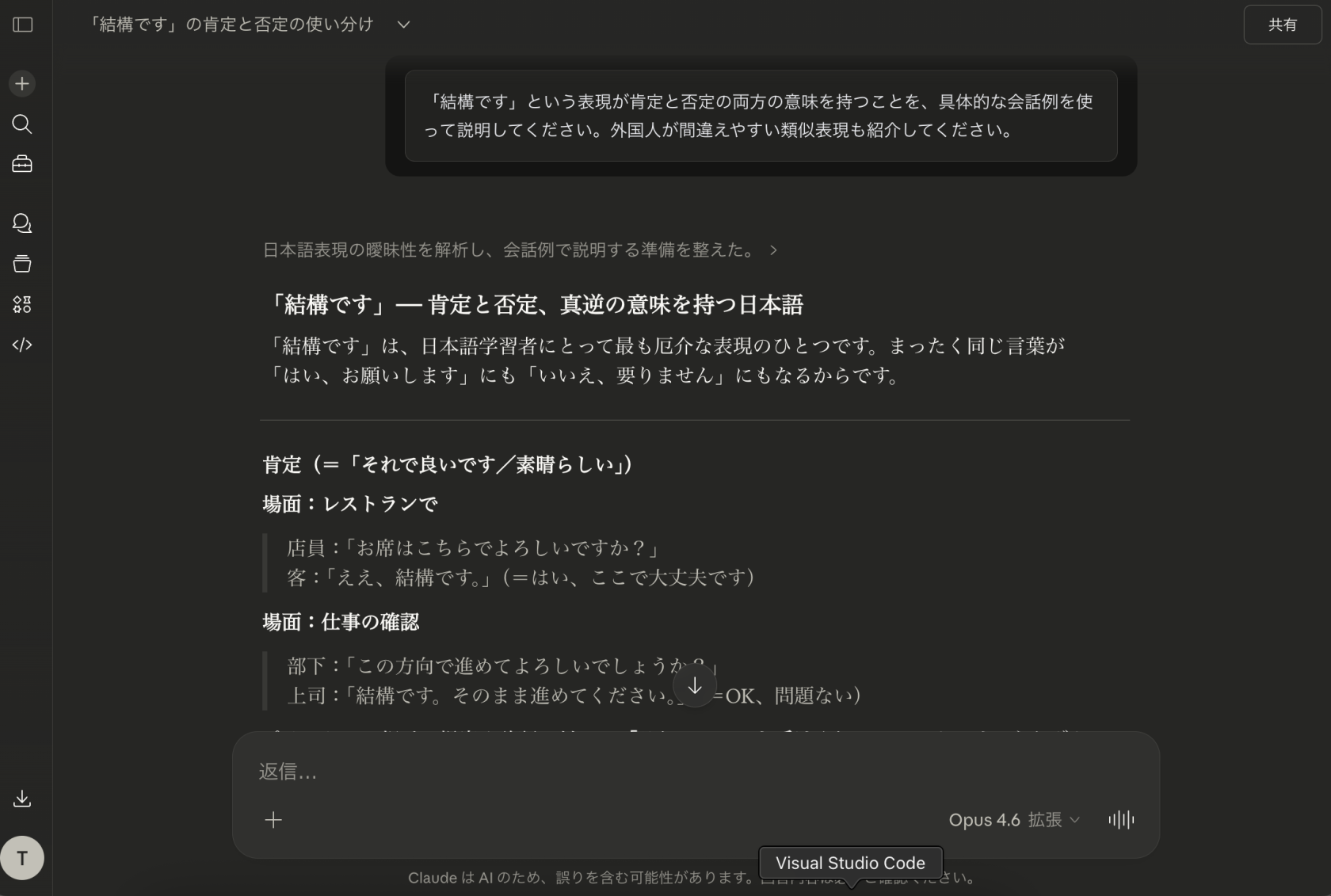

Claudeの回答

肯定(レストランの席確認、仕事の方向性確認)と否定(レジ袋、コーヒーの申し出)を対比し、「見分けるコツ」として「確認への回答→肯定」「申し出への返答→否定」というシンプルなパターンを提示。類似表現として「大丈夫です」「いいです」「考えておきます」「ちょっと難しいです」を紹介しています。

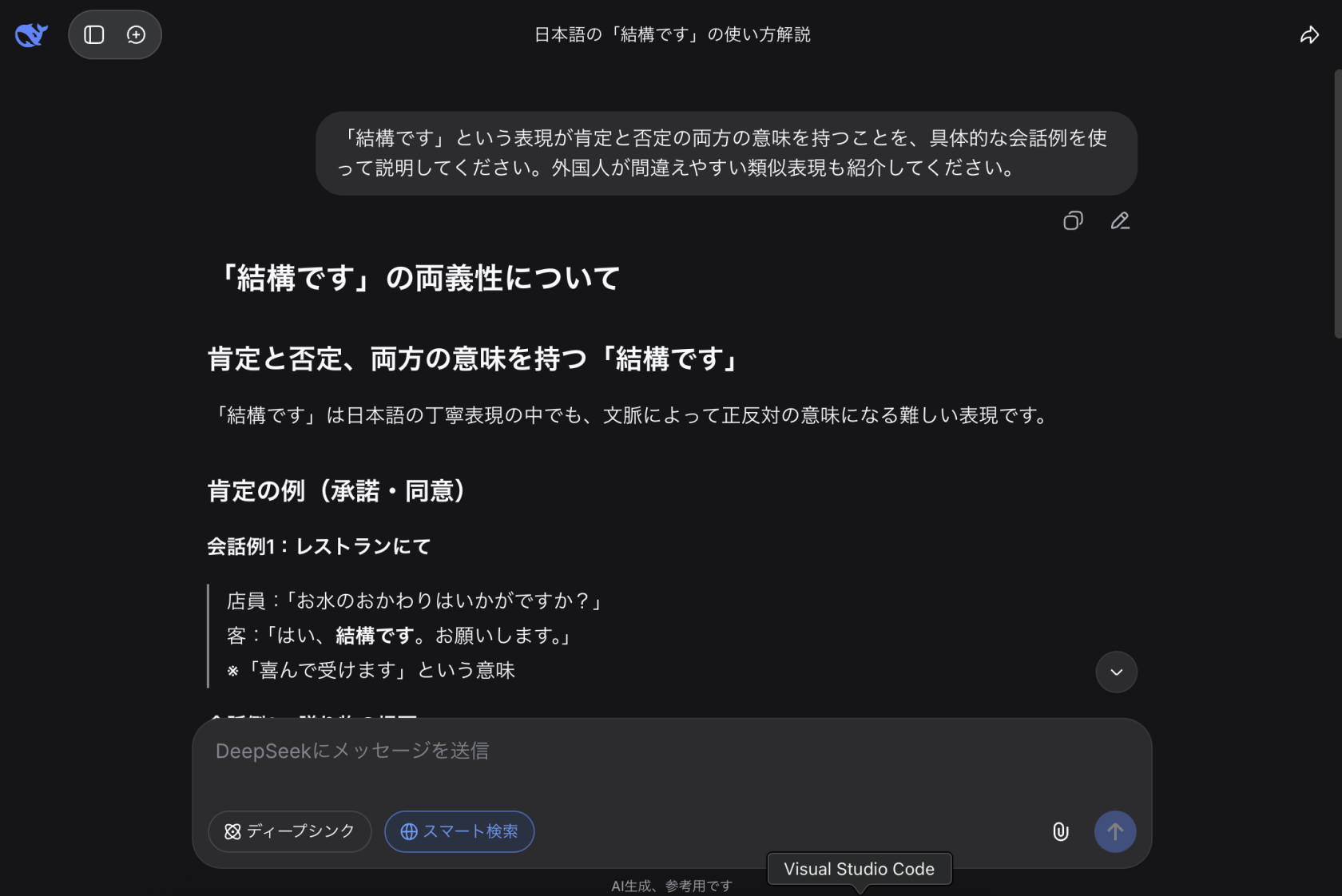

DeepSeekの回答

肯定2例・否定2例の会話例を提示。類似表現として「いいです」「大丈夫です」「けっこう(副詞)」を挙げています。見分け方のポイントとして声のトーン・ジェスチャー・前後の文脈の3点を整理しています。

考察

日本語のニュアンス解説でも3モデルとも高い品質を示しましたが、アプローチに特色が出ました。

- Sakana Chat はソースリンク付きで情報を裏付ける点が他モデルと異なります。これはNamazuモデル自体の能力というよりも、Sakana ChatのシステムがWeb検索結果を回答に統合する設計(システムプロンプトやRAG的な仕組み)によるものと考えられます。また「すみません」の多義性にも触れるなど、カバー範囲が最も広い回答でした

- Claude は「確認→肯定、申し出→否定」という実用的な判別ルールを提示しており、学習者がすぐに使える知識に落とし込んでいます。「考えておきます」「ちょっと難しいです」といったビジネス寄りの表現にも言及しています

- DeepSeek は「けっこう」の副詞用法(「けっこう美味しい」=かなり)にも触れており、形容動詞と副詞の使い分けという文法的な視点を加えています

このテーマでは、Sakana ChatのWeb検索統合がソースリンク付きの回答という形で差別化要素になっています。一方、言語的な正確さそのものは3モデルとも十分なレベルです。

検証4. 日本特有の社会制度(Web検索統合の実力も確認)

日本固有の制度をどこまで正確・実用的に説明できるか。Web検索機能が活かされるかも注目です。

プロンプト

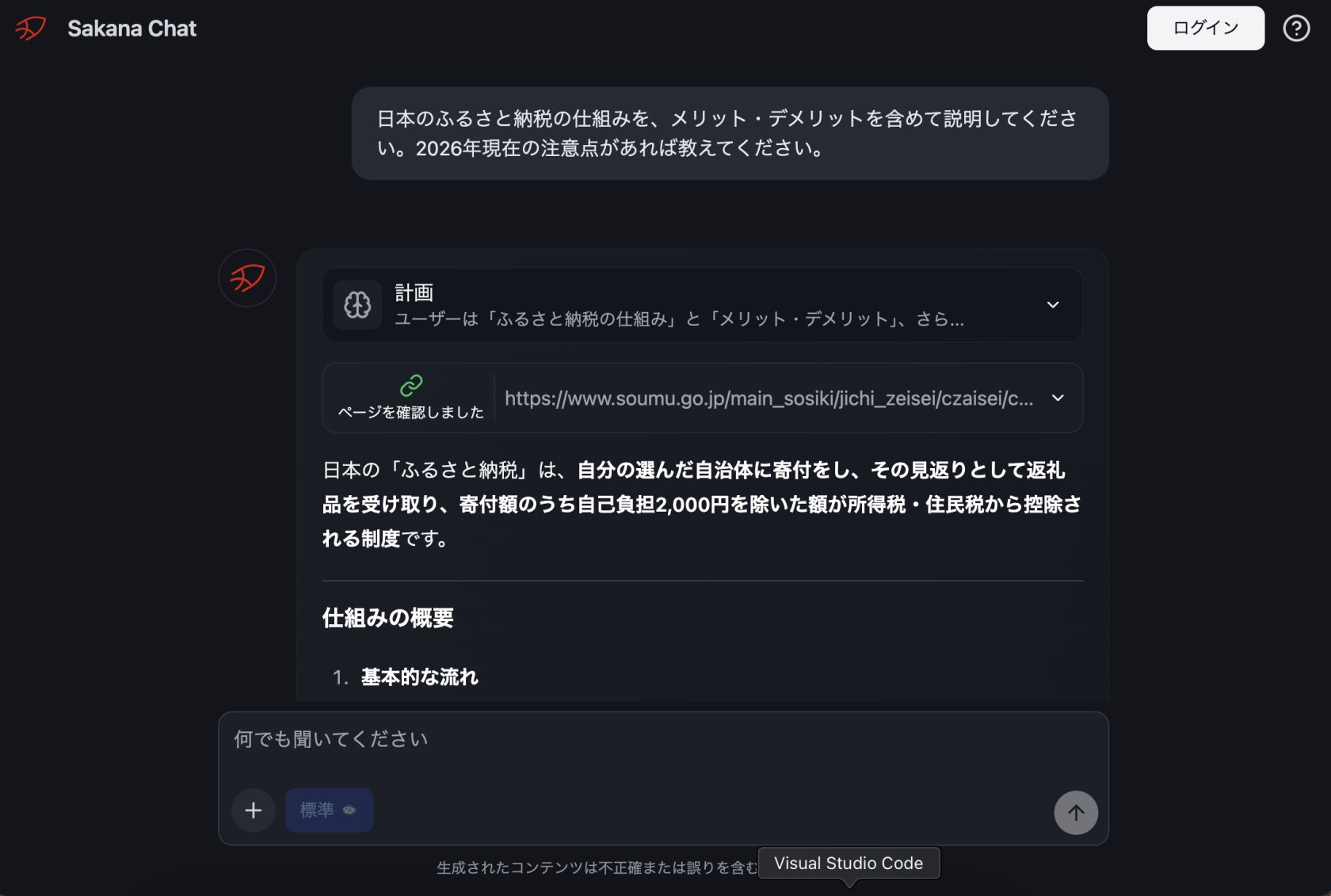

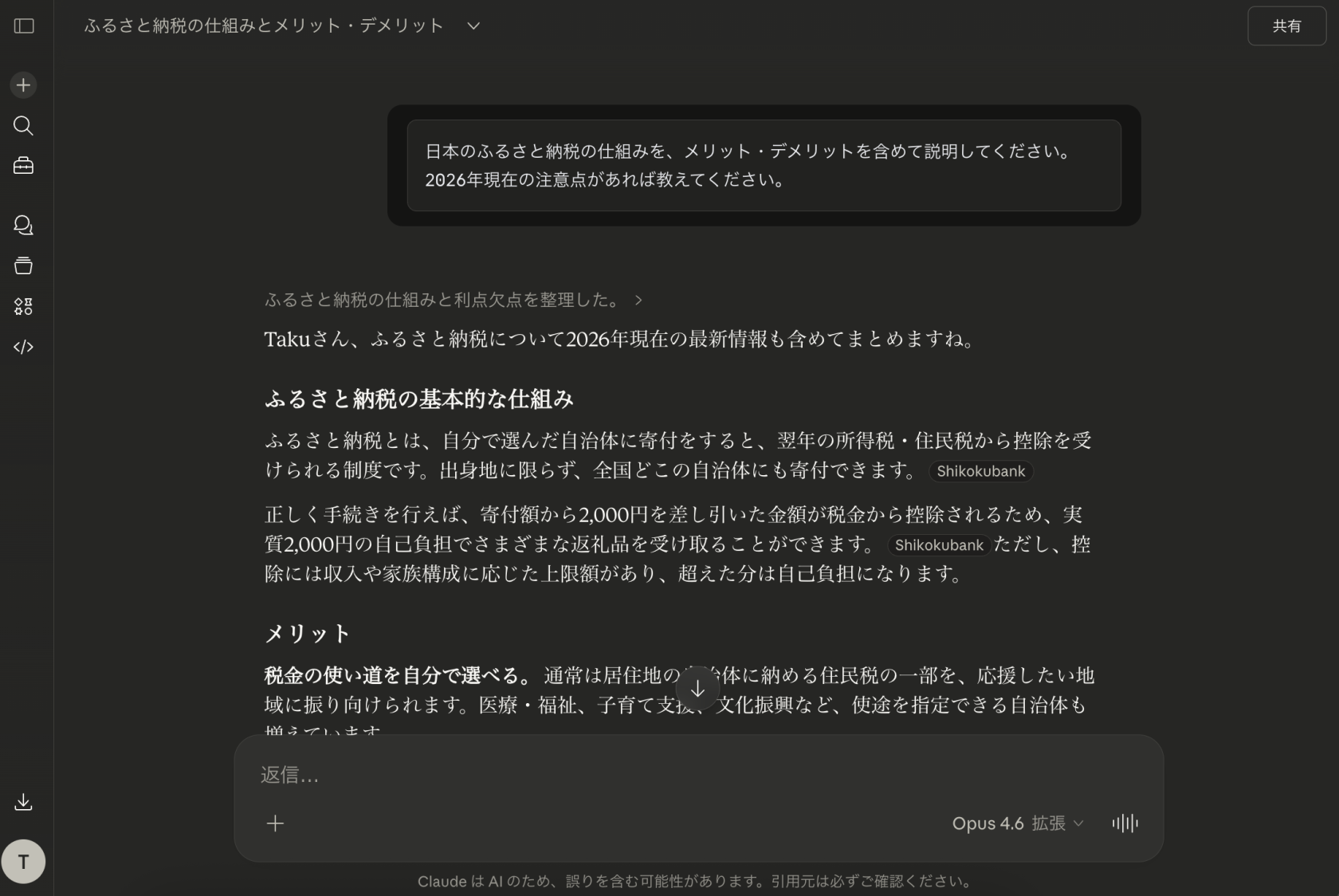

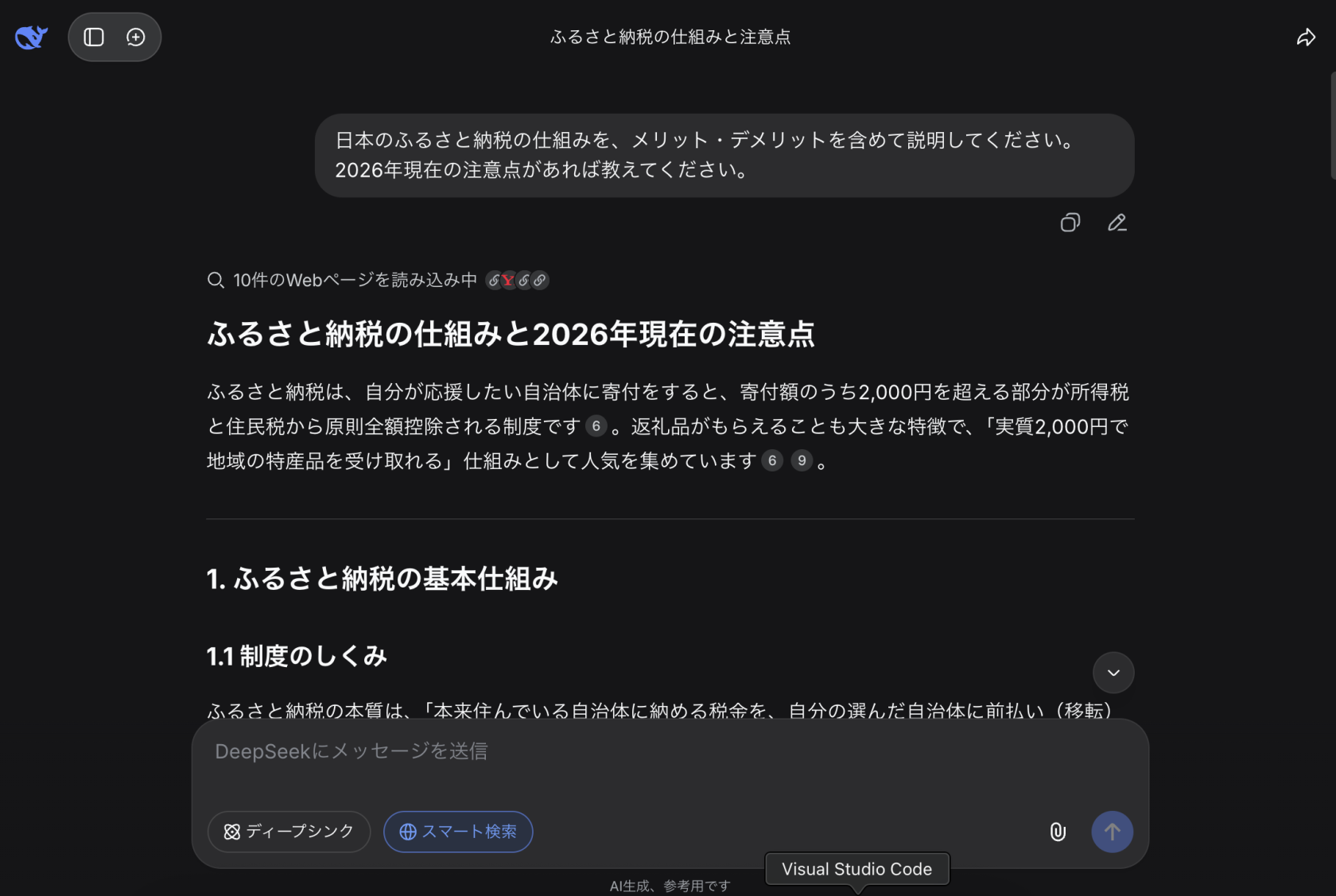

日本のふるさと納税の仕組みを、メリット・デメリットを含めて説明してください。2026年現在の注意点があれば教えてください。Sakana Chatの回答

基本的な仕組み・控除のイメージ・メリット4点・デメリット4点を整理した上で、2026年現在の制度改正として「ポイント付与禁止(2025年10月〜)」「地場産品基準の厳格化(2026年10月〜)」「付加価値基準の明確化」「広報目的基準の見直し」を総務省のソースリンク付きで詳しく解説しています。

Claudeの回答

制度の基本解説に加え、2026年の変更点として「ポイント付与禁止」「地場産品基準厳格化」に加え、「6割ルールの導入」(2029年までに段階的引き上げ)や「富裕層向け上限設定(193万円、2027年度〜)」 にも言及。クレジットカードポイントは引き続き付与対象であることも補足しています。

DeepSeekの回答

制度の基本解説が最も詳細で、控除額の計算式(所得税控除・住民税基本分・特例分)まで具体的に記載。2026年の改正点として「ポイント付与禁止」「地場産品基準厳格化」「富裕層への上限」「6割ルール」を網羅し、さらに「ふるなびマネー」など新しい決済手段の活用ポイントまで提案しています。

考察

この検証は Web検索統合の実力を見る 目的でしたが、興味深い結果になりました。

- Sakana Chat はWeb検索を活用し、総務省のソースリンクを複数付与した回答を生成。2026年10月の制度改正(地場産品基準・付加価値基準・広報目的基準)について公式情報を参照しながら正確に説明しています。ただし、このソースリンク付与はNamazuモデル自体の能力ではなく、Sakana Chatのシステム側でWeb検索結果を統合する仕組み(システムプロンプトやRAG的な構成)によるものと考えられます

- Claude は「6割ルール」や「富裕層向け193万円上限(2027年度〜)」など、Sakana Chatが触れていない制度変更にも言及。モデル内部の知識だけでより幅広い改正点をカバーしています

- DeepSeek は控除計算式の詳細や「ふるなびマネー」など実用的な情報が充実。3モデル中最も情報量が多い回答です

「2026年現在の注意点」という最新情報を問うテーマでは、Sakana Chatはソースリンク付きで出典を確認できるという サービスとしての利便性 が光ります。一方、モデル単体の知識量ではClaude・DeepSeekも十分な精度の回答を生成しており、特にDeepSeekの情報量の充実ぶりは注目に値します。

つまり、Sakana Chatの「ソースリンク付き回答」は モデルの日本文化特化 というよりも サービス設計の強み として評価するのが妥当です。

ふるさと納税のような「制度が頻繁に改正されるテーマ」こそ、ソースリンク付きで最新情報を確認できるSakana Chatの価値が光ると感じました🐰

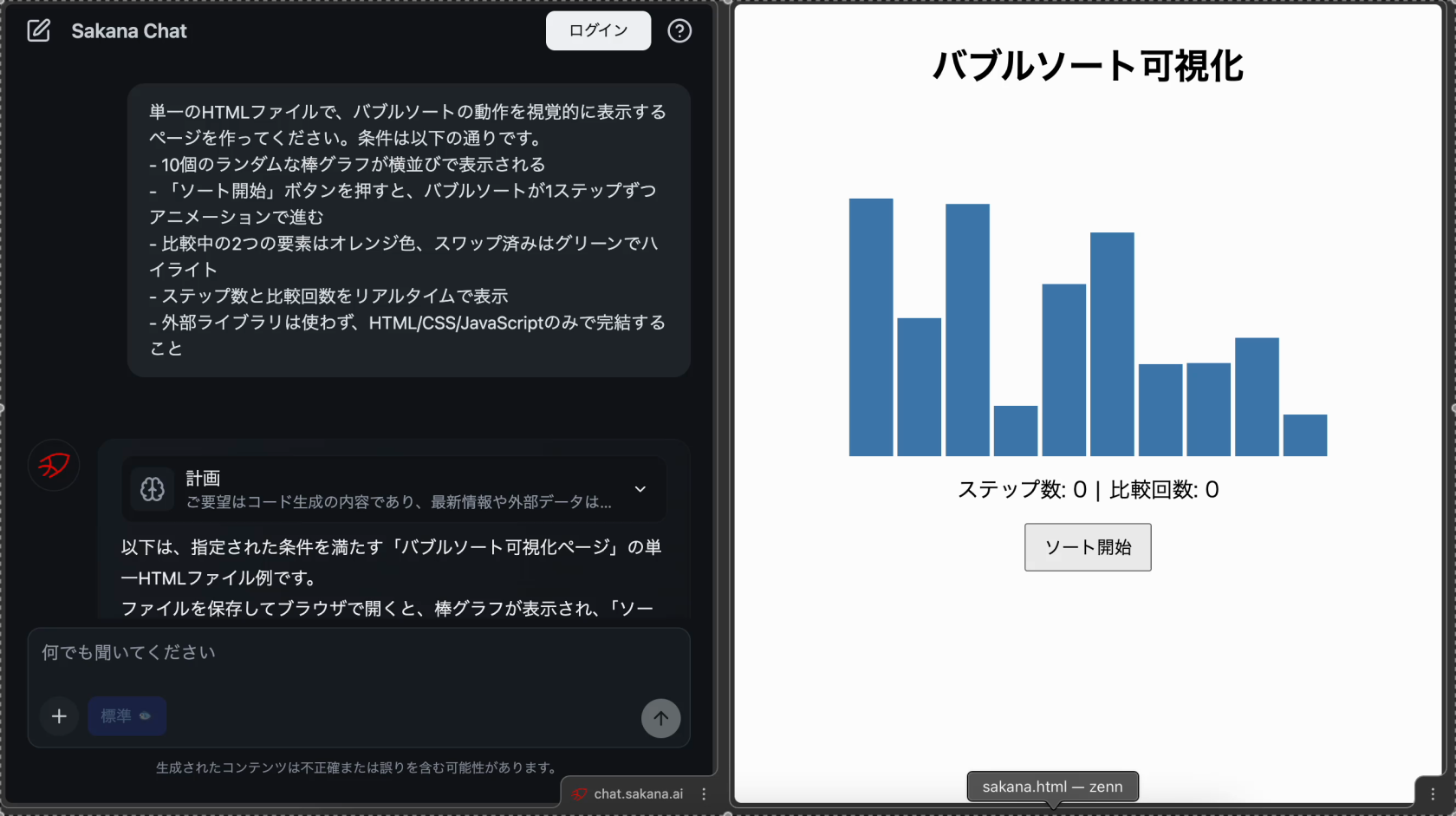

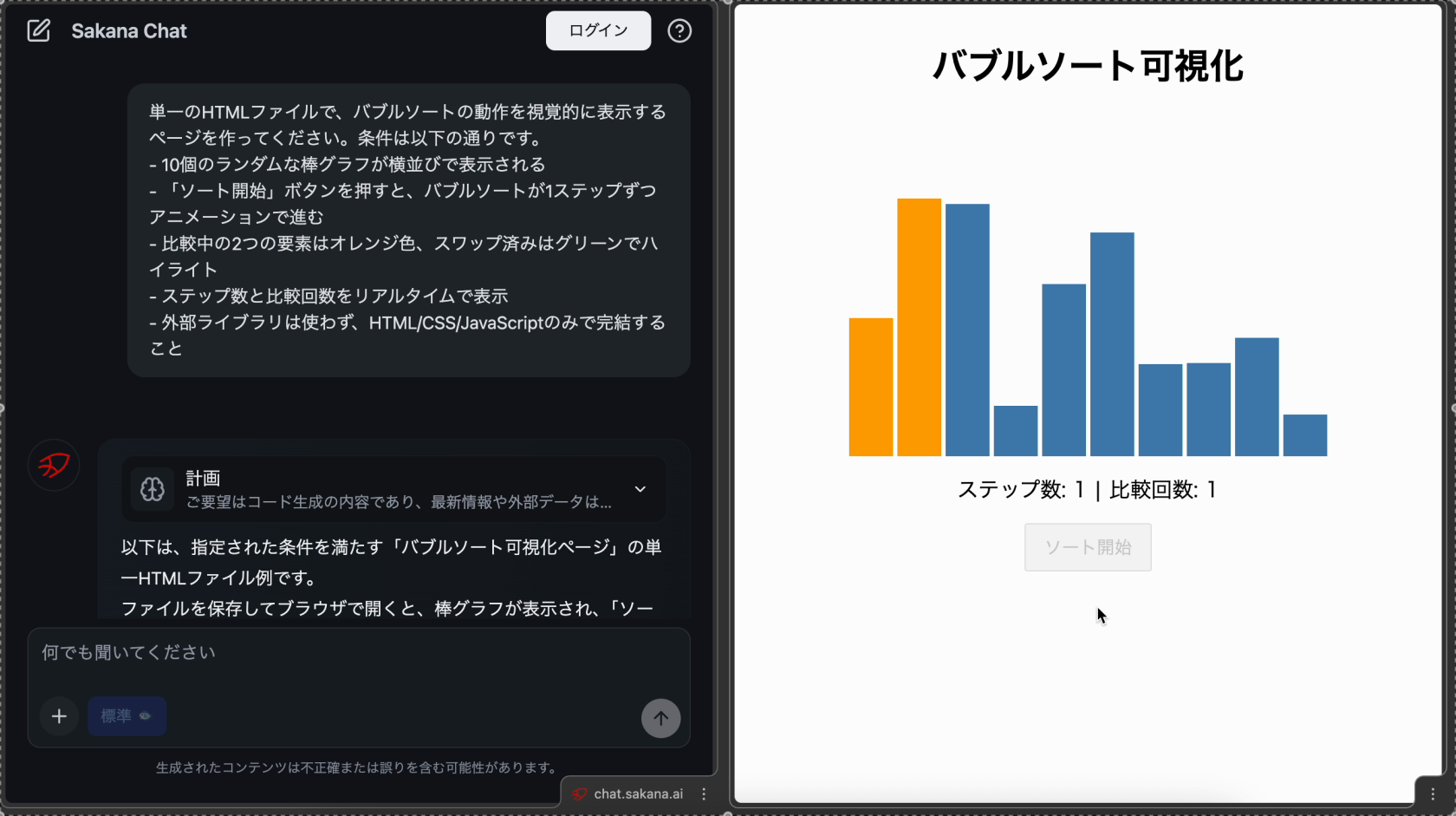

検証5. プログラミング能力(ベースモデルの基礎能力は維持されているか)

事後学習で日本仕様に適応させた結果、ベースモデルが持つコーディング能力が損なわれていないかを確認します。1プロンプトでHTML/CSS/JavaScriptを含む動くUIを生成させ、各モデルの出力結果をそのままブラウザで実行して比較します。

プロンプト

単一のHTMLファイルで、バブルソートの動作を視覚的に表示するページを作ってください。条件は以下の通りです。

- 10個のランダムな棒グラフが横並びで表示される

- 「ソート開始」ボタンを押すと、バブルソートが1ステップずつアニメーションで進む

- 比較中の2つの要素はオレンジ色、スワップ済みはグリーンでハイライト

- ステップ数と比較回数をリアルタイムで表示

- 外部ライブラリは使わず、HTML/CSS/JavaScriptのみで完結することSakana Chatの回答

アルゴリズムのロジック自体は正しく生成できたものの、「ソート開始」ボタンを押すと1ステップだけ実行してボタンが無効化され、それ以上操作できなくなりました。setIntervalやrequestAnimationFrameによる自動進行処理が実装されておらず、かつボタンをdisabledにしてしまうことが原因です。

Claudeの回答

ボタン1回の押下で最後まで自動ソートが完了。比較中のオレンジ色ハイライト、ソート済みのグリーン表示、ステップ数・比較回数のカウントもすべて正常に動作しました。UIデザインも洗練されており、プロンプトの要件を完全に満たしています。

DeepSeekの回答

基本的なアルゴリズムとUIは生成できましたが、ボタンを1回押すと1ステップしか進まず、最後までソートするには何度もボタンを押す必要がある実装でした。プロンプトの「1ステップずつアニメーションで進む」をボタン1回=1ステップと解釈した可能性がありますが、自動で最後まで進む動作は実現できていません。

考察

この検証で見えたのは、事後学習による日本語適応と、ベースモデルのコーディング能力の関係です。

Sakana AIの事後学習技術は、中立性・日本語能力の向上に大きな効果を発揮していますが、コーディングのような基礎能力については課題が見られました。実際にSakana Chatが生成したコードを確認すると、バブルソートのロジックは正しいものの、bubbleSortStep()を1回呼ぶだけでボタンをdisabledにしてしまい、setInterval等による自動繰り返し処理が欠落していました。DeepSeekも同様に自動進行の実装が不完全で、ベースモデル由来の傾向が事後学習後も残っている可能性があります。

一方、Claudeはこの種のフロントエンド生成タスクを得意としており、プロンプトの意図を正確に汲み取って完成度の高いコードを出力しました。DeepSeekは動作こそするものの、UX面の詰めが甘い結果に。

プログラミング検証では、Claudeが頭一つ抜けた結果でした。Sakana Chatは日本語・文化面で光る一方、コーディングタスクは得意分野の海外モデルに任せるのが現時点では賢い使い分けと言えそうです🐰

検証まとめ

| 検証項目 | Sakana Chat | Claude | DeepSeek |

|---|---|---|---|

| 政治的トピック | ◎ 中立的に回答 | ◎ 中立的に回答 | ✕ 回答拒否 |

| 日本文化の理解 | ◎ 網羅的 | ◎ 簡潔で実践的 | ◎ 独自の視点 |

| 日本語ニュアンス | ◎ ソースリンク付き | ◎ 判別ルール明確 | ○ 文法的視点 |

| 日本固有制度+Web検索 | ◎ 総務省リンク付き | ○ 幅広い改正点 | ○ 計算式まで詳細 |

| 推論・プログラミング | △ ロジックは生成できるがバグあり | ◎ 完璧な動作・洗練されたUI | ○ 動作するがUXに課題 |

| 総合的な特徴 | ソース付き・網羅的 | 簡潔・実践的 | 詳細だが検閲あり |

今回の検証から見えてきたSakana Chat(Namazu)の強みと立ち位置を整理します。

Sakana Chatが優位なシーン

- 中国製モデルが回答拒否する政治的トピック(天安門事件、台湾問題など)

- ソースの裏付けが欲しい最新の制度・ニュース情報

- 日本語の文化的背景を含む網羅的な解説

海外モデルが優位なシーン

- コーディングや技術的な質問(専用機能が充実)

- マルチモーダル対応(画像・音声など)

- 簡潔で効率的な回答が欲しい場面(Claude)

Sakana Chatは「海外モデルの完全な代替」ではなく、「日本のトピックに強い選択肢が増えた」 と捉えるのが正確です。特にDeepSeekベースの回答拒否を克服した事後学習技術は、日本のAI開発における重要なマイルストーンと言えるでしょう🐰

まとめ

Sakana Chatは、日本発のAIユニコーンSakana AIが送り出した初の消費者向けチャットサービスです。海外のオープンモデルに独自の事後学習を施し、日本の文化・価値観に適応させた「Namazu」モデルを搭載しています。

Sakana Chatの意義

- 日本のためのAI – データは国内保管、日本文化への理解を強化

- バイアス是正 – 海外モデルの自己検閲や偏りを技術的に解決

- 無料で利用可能 – アカウント不要ですぐに試せる

日本発のAIサービスとして、ぜひ一度試してみてください。特に、海外モデルでは聞きにくかった政治的・歴史的なトピックについて質問してみると、Namazuの実力が実感できるはずです。

あなたも生成AIの活用、始めてみませんか?

生成AIを使った業務効率化を、今すぐ始めるなら

「初月基本料0円」「ユーザ数無制限」のナレフルチャット!

生成AIの利用方法を学べる「公式動画」や、「プロンプトの自動生成機能」を使えば

知識ゼロの状態からでも、スムーズに生成AIの活用を始められます。

ナレフルチャット運営チーム

法人向けクローズド生成AIチャットサービス「ナレフルチャット」の企画・開発・運用を手がけています。

プロンプト自動生成・改善機能や組織内でのノウハウ共有機能など、独自技術の開発により企業の生成AI活用を支援しています。

「AIって難しそう...」という心の壁を、「AIって面白そう!」という驚きで乗り越えていただけるように

日々刻々と変化する生成AI業界の最新動向を追い続け、魅力的な記事をお届けしていきます。