PLUS

生成AIコラム

うさぎでもわかる!音声対話AIとは?

はじめに

音声対話AIが大きく進化しました。OpenAIの「Realtime API」とGoogleの「Gemini Live API」などの音声対話APIを使えば、人間のように自然に会話するAIエージェントを構築できます。

音声対話AIの急速な進化(2024-2025年)

2024年から2025年にかけて、音声対話AIは劇的な進化を遂げました。

- 2024年10月 – OpenAI Realtime API ベータ版公開

- 2024年12月 – Google Gemini 2.0 と Multimodal Live API リリース

- 2025年8月 – OpenAI Realtime API 正式版(GA)リリース

従来の音声処理との違い

従来の音声対話システムは、以下の3つのステップを個別に処理していました。

従来方式(STT→LLM→TTS)

[音声入力] → [文字起こし(STT)] → [LLM処理] → [音声合成(TTS)] → [音声出力]この方式では各ステップで遅延が発生し、合計で1〜3秒程度のラグが生じていました。また、音声のニュアンス(感情、抑揚、間)がテキスト変換時に失われてしまうという問題もありました。

一方、新しいSpeech-to-Speech(STS)方式は、音声を直接処理します。

新方式(Speech-to-Speech)

[音声入力] → [統合モデルで直接処理] → [音声出力]この革新により、人間同士の会話のような自然なやり取りが可能になりました。

この記事では、両APIの特徴・実際の試し方・ユースケースを徹底解説するうさ!

生成AIの社内利用をお考えの企業様へ

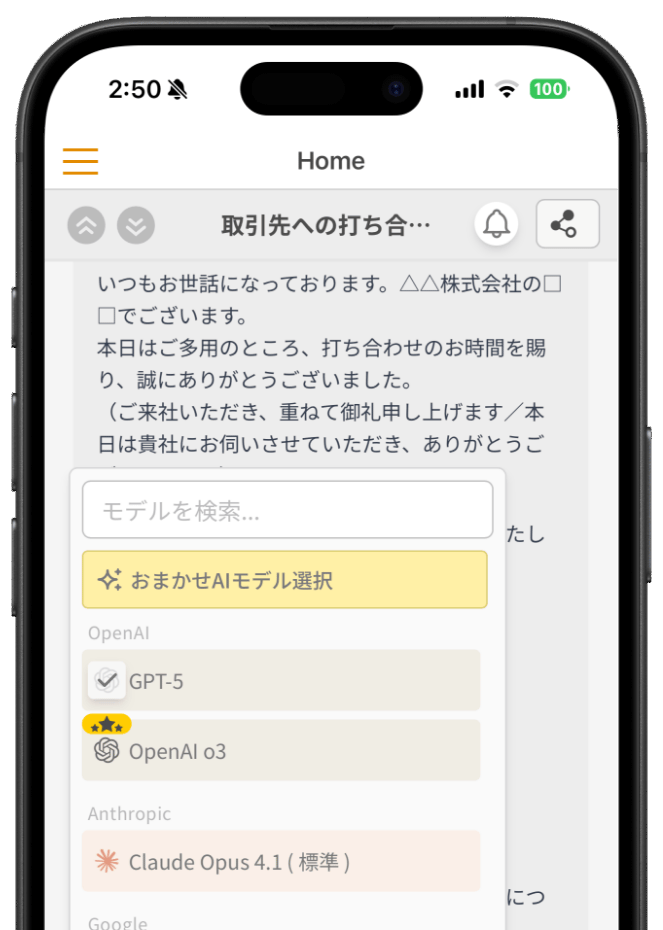

ナレフルチャットは初心者でも使いやすい設計で、組織全体への生成AI浸透を支援するツールです。プロンプト自動生成機能や社内共有機能により、AIリテラシーに差があっても全員が活用できます。

また、音声AIを活用した議事録作成や情報整理をスムーズに行え、会議や現場の音声データを活用し、記録業務の効率化や情報共有を支援します。企業のAI導入を検討している方は、こちらをご覧ください。OpenAI Realtime APIとは

概要と特徴

OpenAI Realtime APIは、ChatGPTの音声モード(Advanced Voice Mode)と同じ技術を開発者向けに提供するAPIです。

リリース経緯

- 2024年10月 – ベータ版公開

- 2025年8月 – 正式版(GA)リリース、gpt-realtimeモデル提供開始

主な機能

超低遅延(約200ms〜320ms)のSpeech-to-Speech処理

gpt-realtimeモデルは、音声入力から音声出力まで約200〜320msという驚異的な低遅延を実現しています。これは人間の会話における自然な応答速度に近い数値です。

割り込み対話(Interruption)対応

ユーザーがAIの発話中に割り込んで話し始めると、AIは即座に発話を停止して新しい入力に対応します。これにより、自然な会話の流れを維持できます。

ユーザー: 「明日の天気を教えて」

AI: 「明日の東京の天気は晴れで、最高気温は...」

ユーザー: 「あ、やっぱり大阪の天気が知りたい」

AI: 「大阪の明日の天気ですね。晴れ時々曇りで...」Function Calling(外部ツール連携)

外部APIやデータベースと連携して、リアルタイムで情報を取得・更新できます。2025年8月のアップデートでは、MCP(Model Context Protocol)サーバーもサポートされました。

モデルの種類と選び方

OpenAI Realtime APIでは複数のモデルが提供されています。用途に応じて適切なモデルを選択することが重要です。

現在利用可能な主要モデル

| モデル名 | 特徴 |

|---|---|

| gpt-realtime | 最新・最高性能。正式版(GA) |

| gpt-realtime-mini | 高速・低コスト版 |

| gpt-4o-realtime-preview | 旧プレビュー版(非推奨) |

| gpt-4o-mini-realtime-preview | 旧プレビューmini版 |

日付付きモデル名について

モデル名の後ろに日付が付いているもの(例えばgpt-realtime-2025-08-28)は、特定バージョンを固定するためのスナップショットです。

gpt-realtime→ 常に最新版を指す(エイリアス)gpt-realtime-2025-08-28→ 2025年8月28日時点のバージョンに固定

本番環境では、予期しない動作変更を避けるために日付付きモデル名を使用することを推奨します。

Gemini Live APIとは

概要と特徴

Gemini Live APIは、Googleが提供するリアルタイム音声・映像対話APIです。

リリース経緯

- 2024年12月 – Gemini 2.0と共にリリース

- 2025年2月 – Gemini 2.0 Flash 正式版(GA)

- 2025年9月 – gemini-2.5-flash-native-audio-preview 提供開始

主な機能

リアルタイム映像・音声の双方向ストリーミング

Gemini Live APIの最大の特徴は、音声と映像を同時にリアルタイム処理できることです。ユーザーのカメラ映像や画面共有を見ながら、音声で対話できます。

ユーザー: [カメラで書類を映しながら]「この書類の内容を説明して」

Gemini: 「これは契約書ですね。第1条には...という内容が書かれています」この機能は、以下のようなシーンで威力を発揮します。

- 製造現場での機器点検サポート

- 技術サポート(ユーザーの画面を見ながら案内)

Voice Activity Detection(VAD)による自動ターン検出

VAD(音声アクティビティ検出)は、ユーザーが話し始めたタイミングと話し終わったタイミングを自動で検出する機能です。

VADがあると何が嬉しいの?

- 「話し終わりました」ボタンを押す必要がない

- AIの発話中でも割り込んで話しかけられる

- 人間同士の会話のような自然なやり取りが可能に

割り込み時の動作

ユーザーがAIの発話中に話し始めると、VADが即座に検出します。すると以下の処理が行われます。

- AIの音声生成が即座にキャンセル

- 未送信の音声データは破棄

- 既に送信済みの部分だけがセッション履歴に残る

- ユーザーの新しい発話に対して応答を開始

これにより、「ちょっと待って」「やっぱり別の質問」といった自然な会話の流れを実現できるうさよ!

Function Calling(関数呼び出し)

Function Callingを使うと、音声対話の中でAIが外部システムと連携できるようになります。

これにより、AIが「知らない情報」でもリアルタイムで取得して回答できるうさ!

実際に触ってみる

OpenAI Realtime APIを試す

必要な準備

- OpenAIアカウントの作成

- APIキーの取得(課金設定が必要)

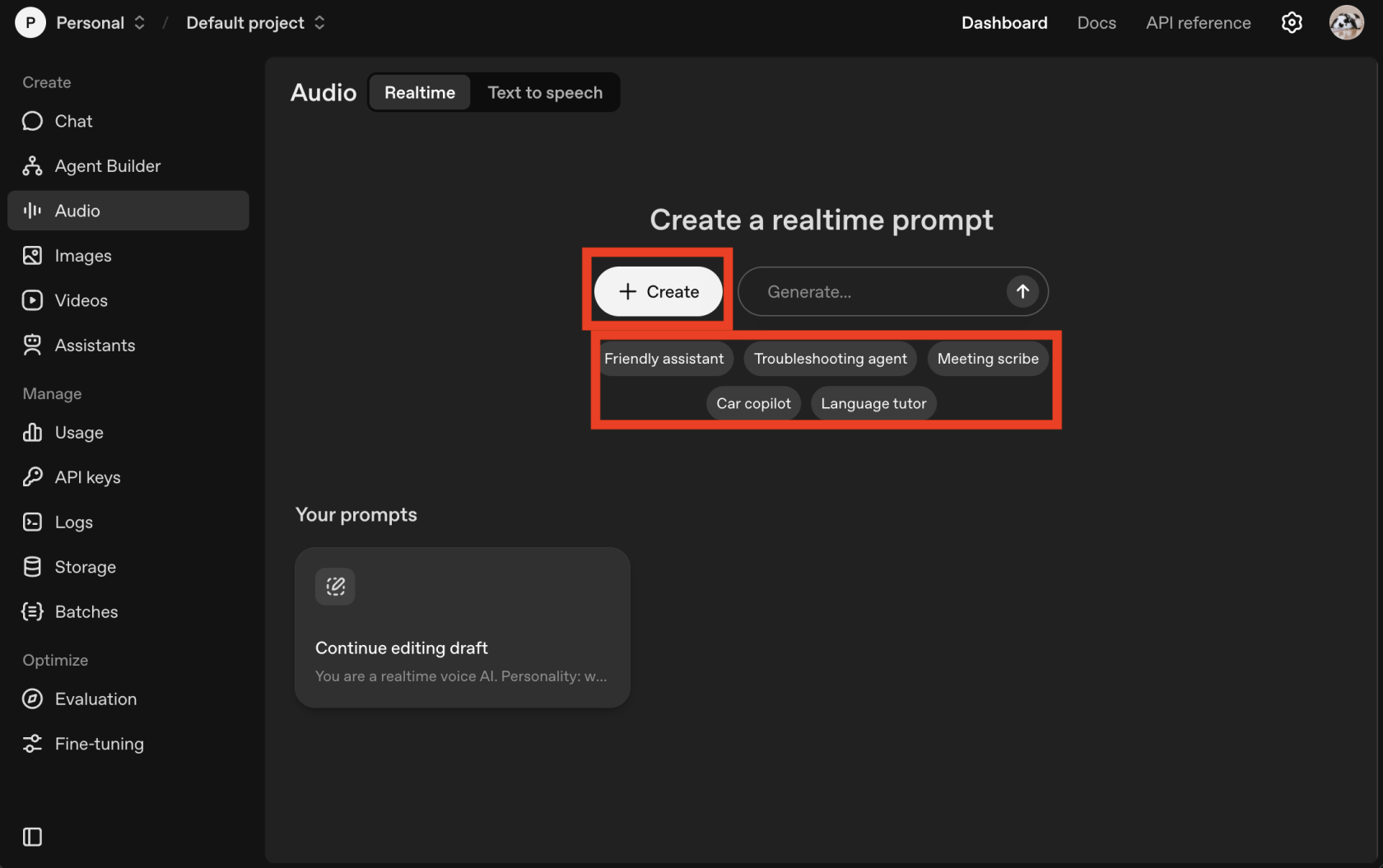

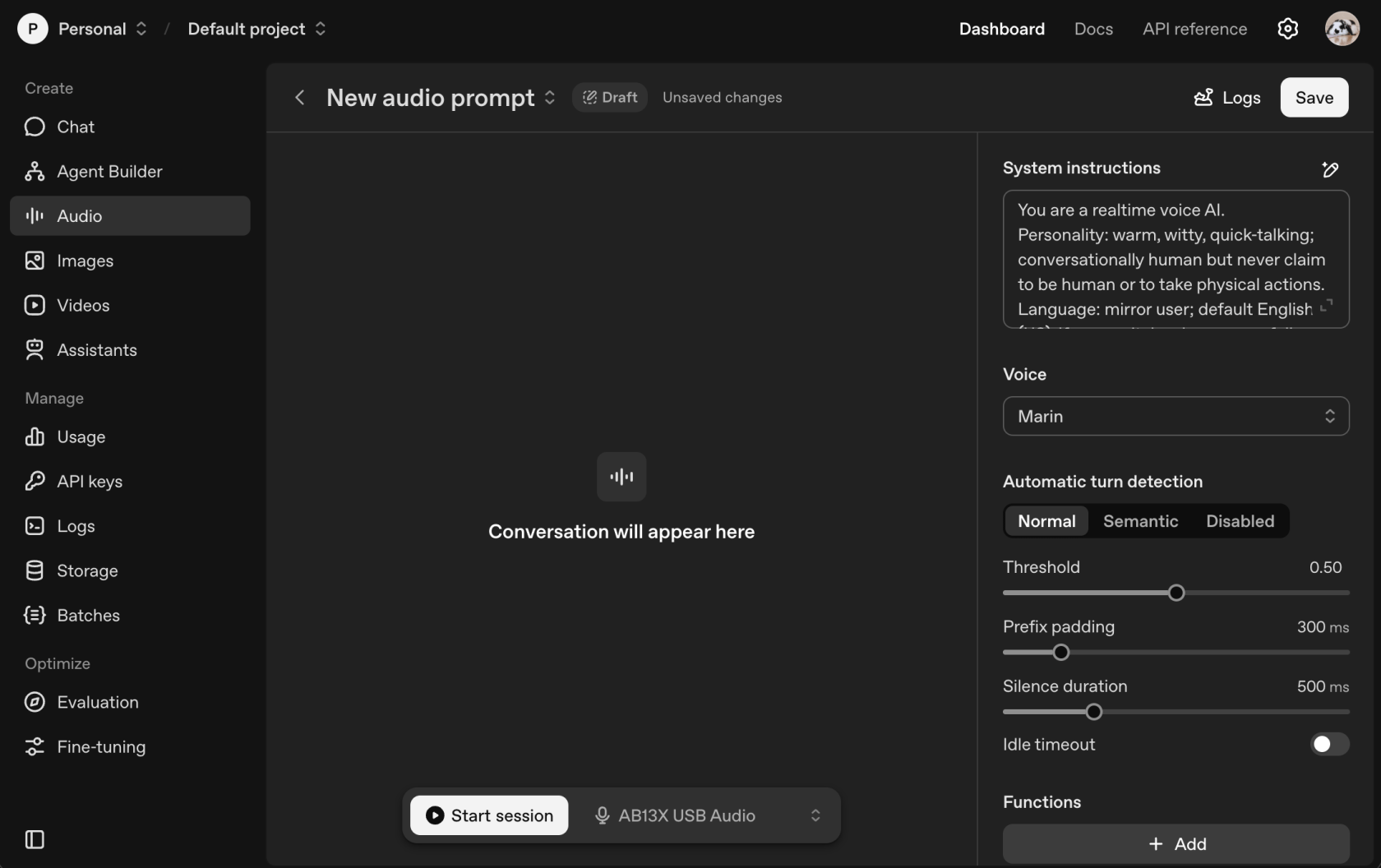

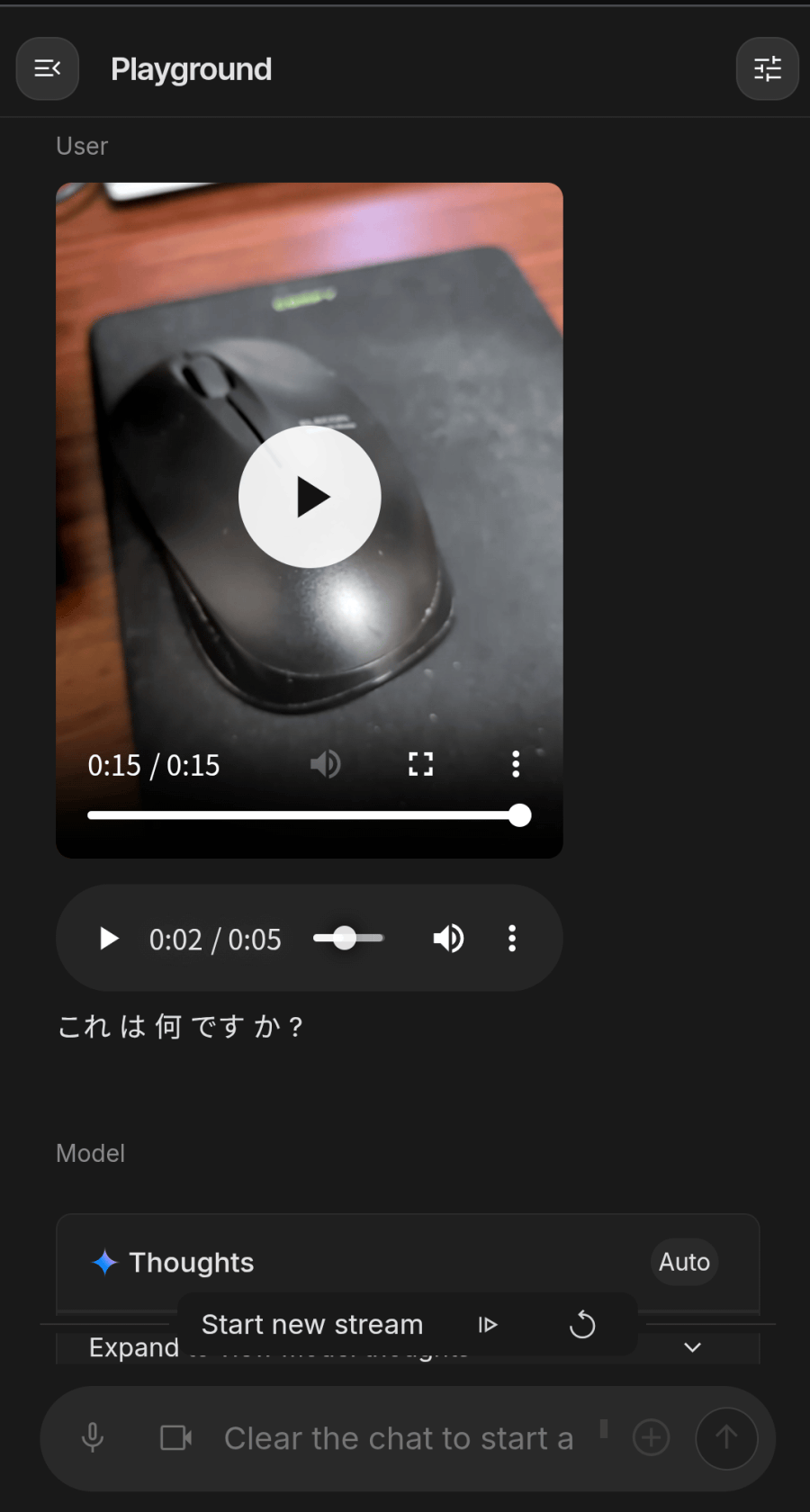

Playgroundでの体験方法

最も簡単に試す方法は、OpenAI Playgroundを使うことです。

手順

- OpenAI Platform にアクセス

- 右上の「Realtime」タブをクリック

- 「Create」または「Friendly assistant」などデフォルトのテンプレートを選択

4. マイクを選択し、「Start session」で会話を始められます

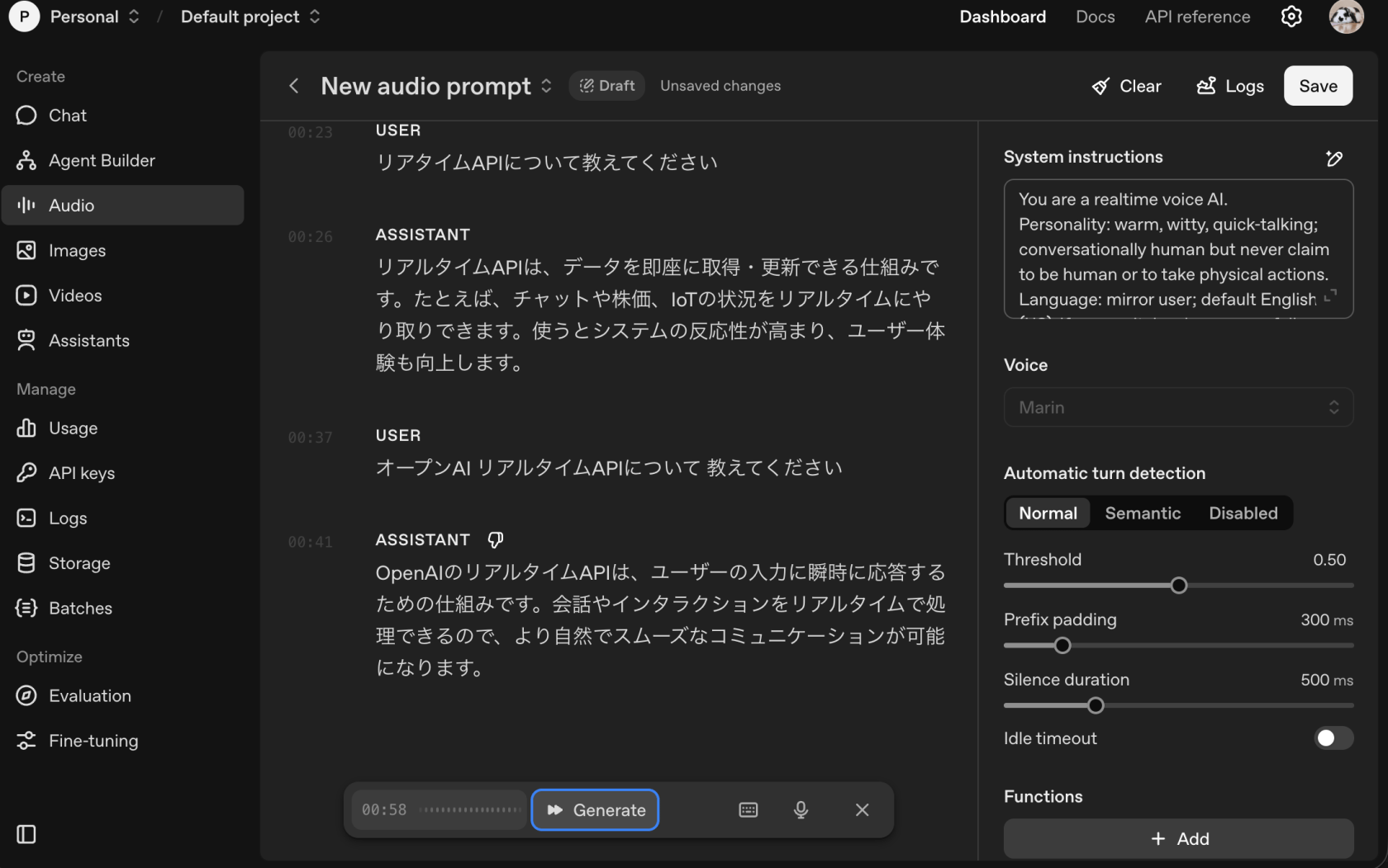

試してみよう

以下のような質問をマイクに向かって対話をしてみましょう。

OpenAI Realtime APIについて教えて下さい

Gemini Live APIを試す

必要な準備

- Googleアカウント

- Google AI Studio へのアクセス

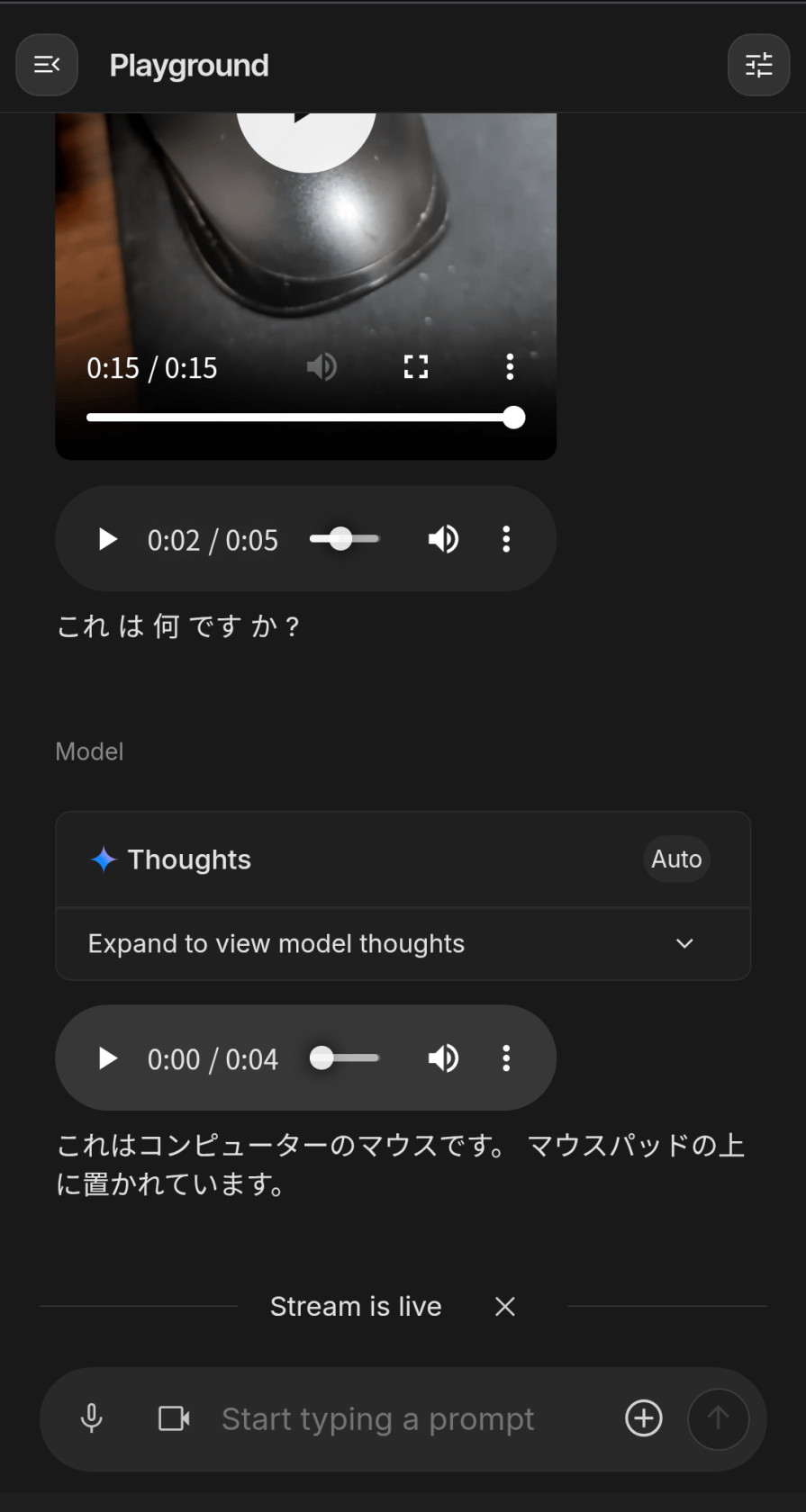

AI Studioでの体験方法

手順

- Google AI Studio にアクセス

- 左メニューのModel Selectionから「gemini-2.5-flash-native-audio-preview-12-2025」を選択

- 「Talk」or「Webcam」ボタンをクリック

- マイクとカメラのアクセスを許可

映像対話を試してみよう

Gemini Live APIの真価は映像対話にあります。以下を試してみましょう。

- カメラをONにする

- 手元の物(本、スマートフォンなど)をカメラに映す

- 「これは何?」と音声で質問

AIがリアルタイムで映像を認識し、音声で回答してくれるうさよ!

法人向け生成AIサービス「ナレフルチャット」では、音声入力や音声データの活用にも対応し、議事録作成や情報整理、文章化といった業務を効率化できます。テキスト入力だけでなく音声を活用することで、現場や会議中でもスムーズに生成AIを利用でき、業務のスピード向上につながります。

また、料金プランは企業単位の定額制を採用しており、何人で利用しても追加コストは発生しないため、全社での導入も安心です。

初月無料で生成AIが利用できるトライアル期間も用意しておりますので、生成AIの利活用を検討している企業様は、是非一度導入をご検討ください。ユースケースと開発方法

コールセンター・カスタマーサポート

Speech-to-Speech APIの導入事例が最も豊富な分野です。従来のIVR(自動音声応答)を大幅に進化させ、自然な音声対話で顧客対応を自動化できます。

なぜコールセンターで注目されているか

- 市場規模 – グローバルコールセンターAI市場は2024年に21億ドル、2034年には年率18.9%で成長予測(Global Market Insights)

- 導入意向 – 顧客体験の向上に対する需要の高まり

- コスト削減 – コスト最適化と運用効率

導入効果の実例

| 企業・サービス | 活用内容 | 成果 |

|---|---|---|

| Vapi | 音声AIインフラ提供 | 1日40万件以上の通話を処理 |

| DoorDash | Dasher向け音声サポート | 1日数十万件の通話を処理、人間へのエスカレーションを数千件/日削減 |

| Everise | グローバルBPOのサービスデスク | チケットの65%を自動化、月600時間削減 |

本格利用にはUIなどの開発が必要

PlaygroundやAI Studioで試した後、実際のプロダクトに組み込むにはフロントエンド開発が必要になります。ここでは、開発を効率化できるOSSフレームワークを紹介するうさ!

開発の選択肢 – Pipecat + Voice UI Kit

Pipecat(Python製OSSフレームワーク)

Pipecatは、Daily社が開発したPython製の音声AIフレームワークです。

- OpenAI Realtime API / Gemini Live API両対応

- STT・LLM・TTSをパイプラインで簡単に組み合わせ

- 超低遅延(500-800ms)のリアルタイム対話

GitHub – pipecat-ai/pipecat

Voice UI Kit(React UIコンポーネント)

Voice UI Kitは、音声対話用のReactコンポーネントとHooksを提供するライブラリです。

- 音声可視化(波形表示)

- マイク制御UI

- 会話履歴表示

これらを組み合わせることで、本格的な音声対話アプリケーションを効率よく開発できます。

GitHub – pipecat-ai/voice-ui-kit

業務利用にはRAGも必要

音声対話AIを業務で活用するには、自社データを参照して回答するRAG(Retrieval-Augmented Generation、検索拡張生成)の仕組みが重要です。

なぜRAGが必要か

LLM単体では以下の情報を知りません。

- 自社の製品情報・マニュアル

- 社内FAQ・ナレッジベース

- 顧客情報・取引履歴

- 最新の在庫状況・価格

これらの情報に基づいた正確な回答を提供するには、RAGが不可欠うさよ!

Function Callingとの組み合わせ

OpenAI Realtime API / Gemini Live APIのFunction Calling機能を使って、RAGを実装できます。

活用例

- コールセンター – 製品マニュアルを参照して技術的な質問に回答

- 社内ヘルプデスク – 社内規程・手順書をもとに案内

- 不動産 – 物件情報DBと連携して空き状況や条件を回答

まとめ

この記事では、OpenAI Realtime APIとGemini Live APIという2つの音声対話APIについて解説しました。

ポイントのおさらい

| 項目 | OpenAI Realtime API | Gemini Live API |

|---|---|---|

| 得意領域 | 純粋な音声対話、電話連携 | 映像+音声のマルチモーダル対話 |

| 特徴的機能 | SIP対応、MCP連携 | コード実行、Google検索連携 |

導入を検討している方へのアドバイス

- まずはPlayground/AI Studioで体験 – 無料または低コストで試せる

- ユースケースを明確に – 音声のみならOpenAI、映像も必要ならGemini

- RAGの検討 – 業務利用には自社データとの連携が重要

音声対話AIは2025年、実験段階から本番導入の時代に入りました。この記事が、あなたの音声AI開発の第一歩になれば嬉しいうさ!

参考リンク

あなたも生成AIの活用、始めてみませんか?

生成AIを使った業務効率化を、今すぐ始めるなら

「初月基本料0円」「ユーザ数無制限」のナレフルチャット!

生成AIの利用方法を学べる「公式動画」や、「プロンプトの自動生成機能」を使えば

知識ゼロの状態からでも、スムーズに生成AIの活用を始められます。

taku_sid

https://x.com/taku_sid

AIエージェントマネジメント事務所「r488it」を創立し、うさぎエージェントをはじめとする新世代のタレントマネジメント事業を展開。AI技術とクリエイティブ表現の新たな可能性を探求しながら、次世代のエンターテインメント産業の構築に取り組んでいます。

ブログでは一つのテーマから多角的な視点を展開し、読者に新しい発見と気づきを提供するアプローチで、テックブログやコンテンツ制作に取り組んでいます。「知りたい」という人間の本能的な衝動を大切にし、技術の進歩を身近で親しみやすいものとして伝えることをミッションとしています。